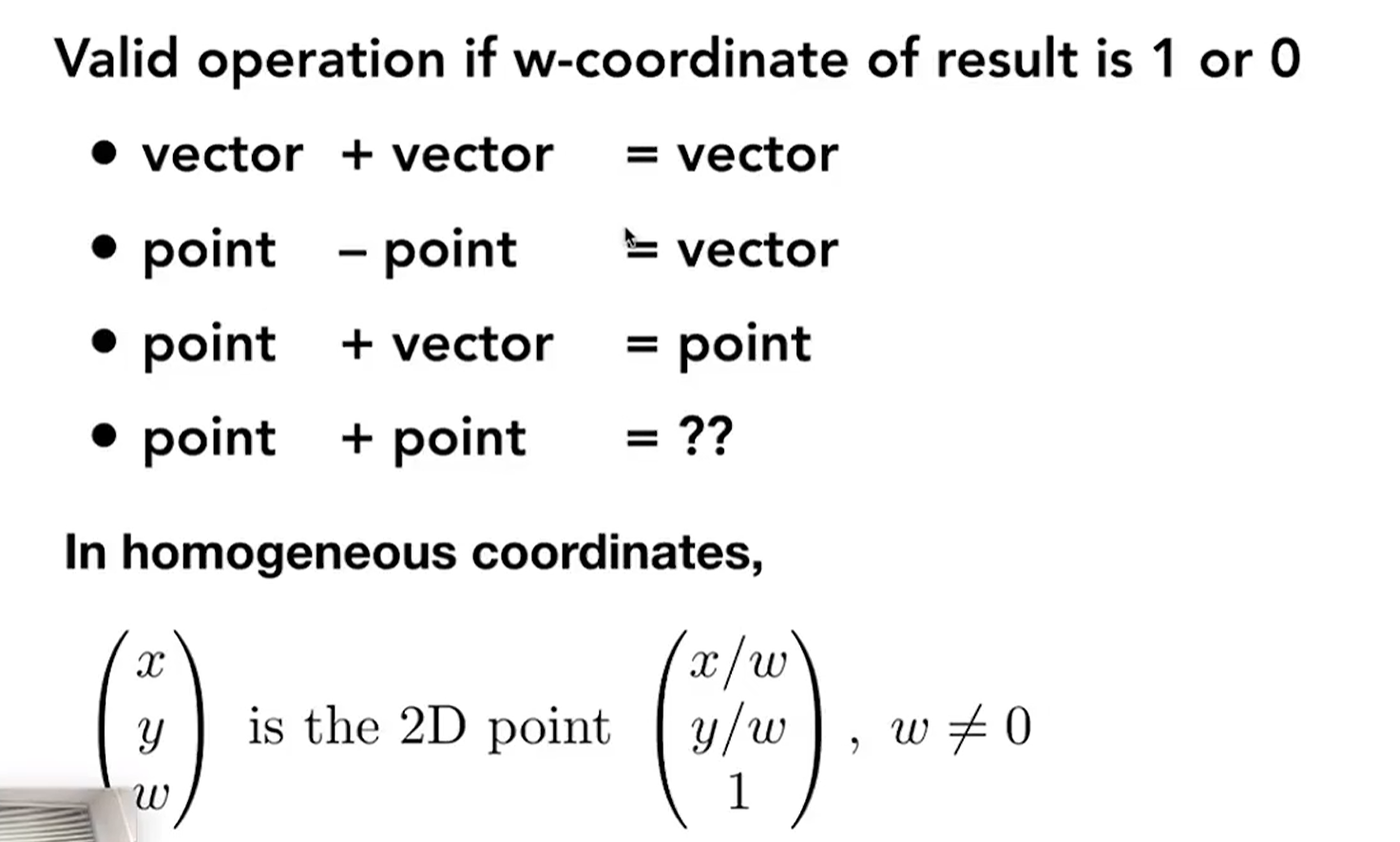

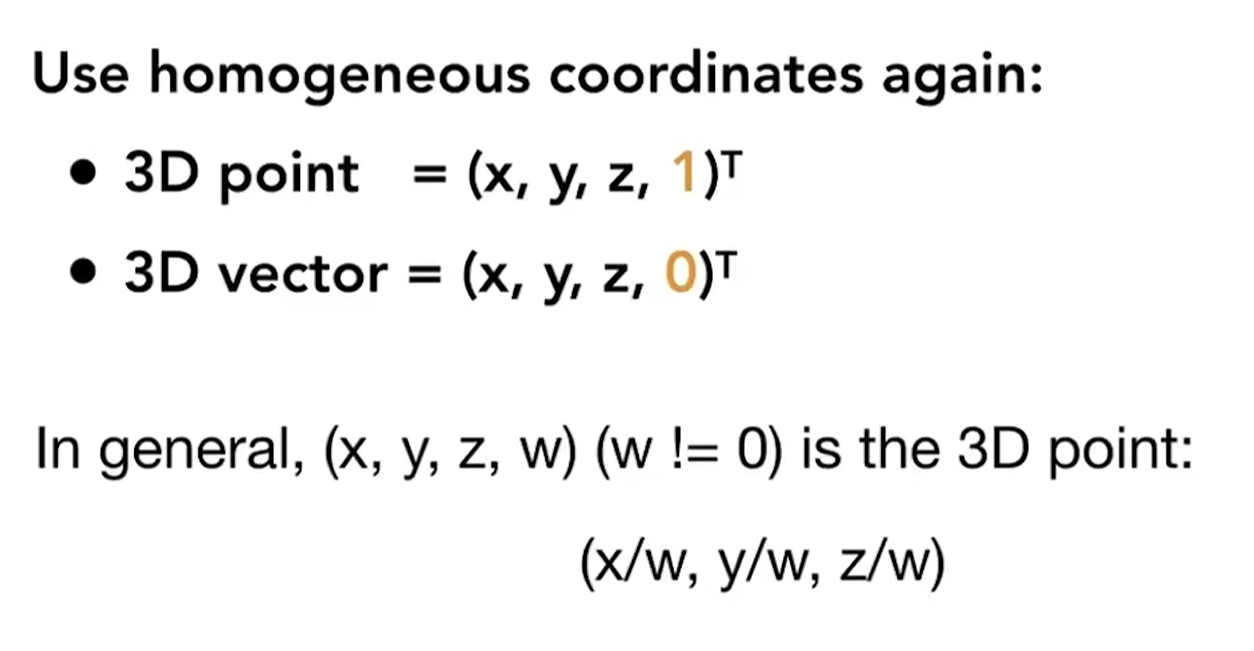

- 2D point = $(x,y,1)^T$

- 2D vector = $(x,y,0)^T$ --- 平移不变性

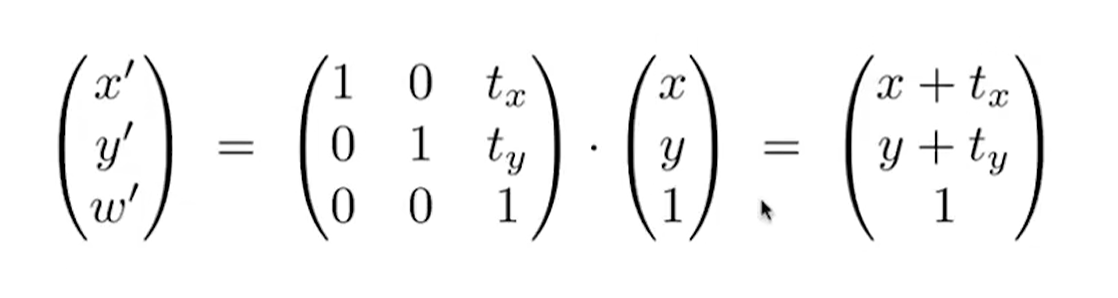

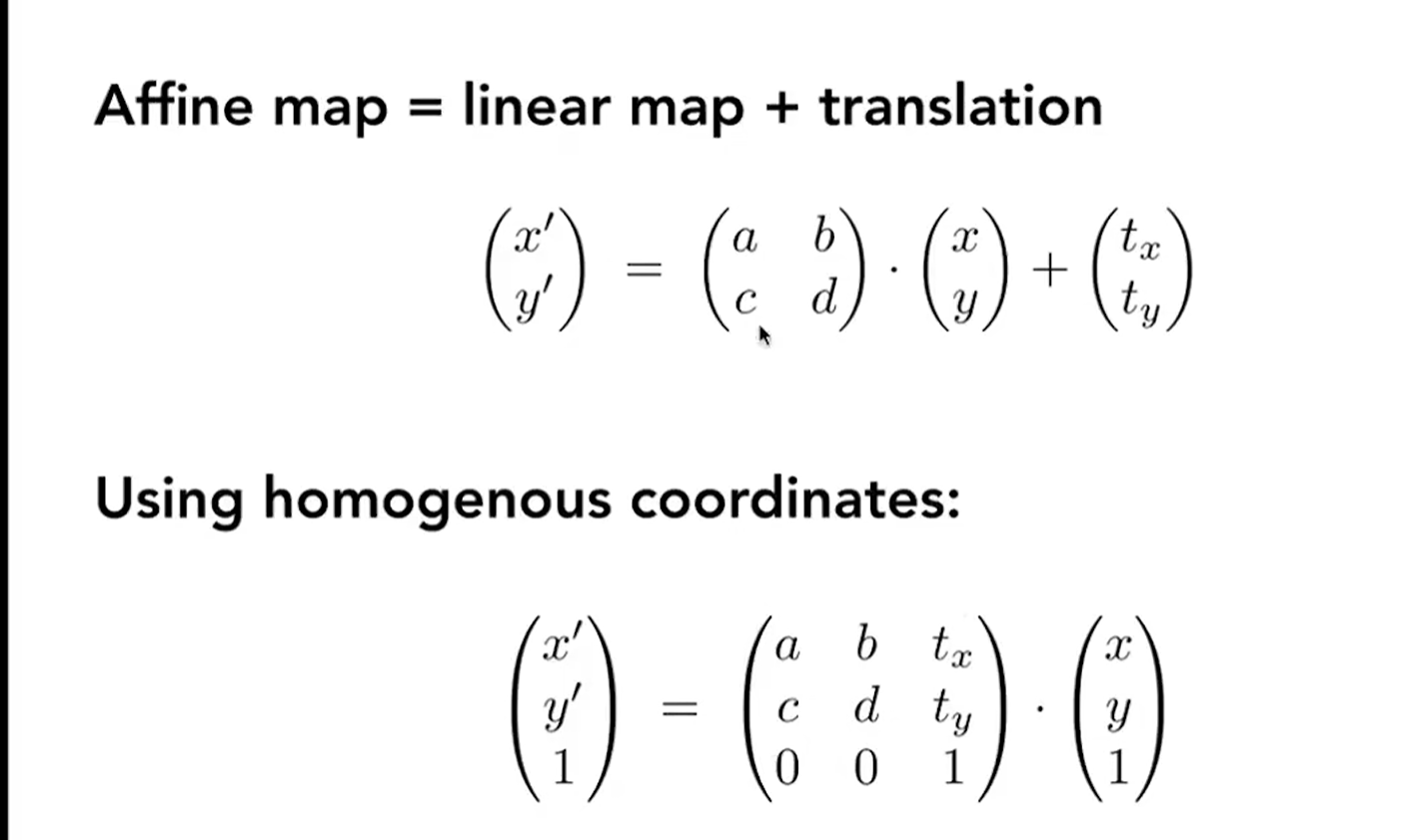

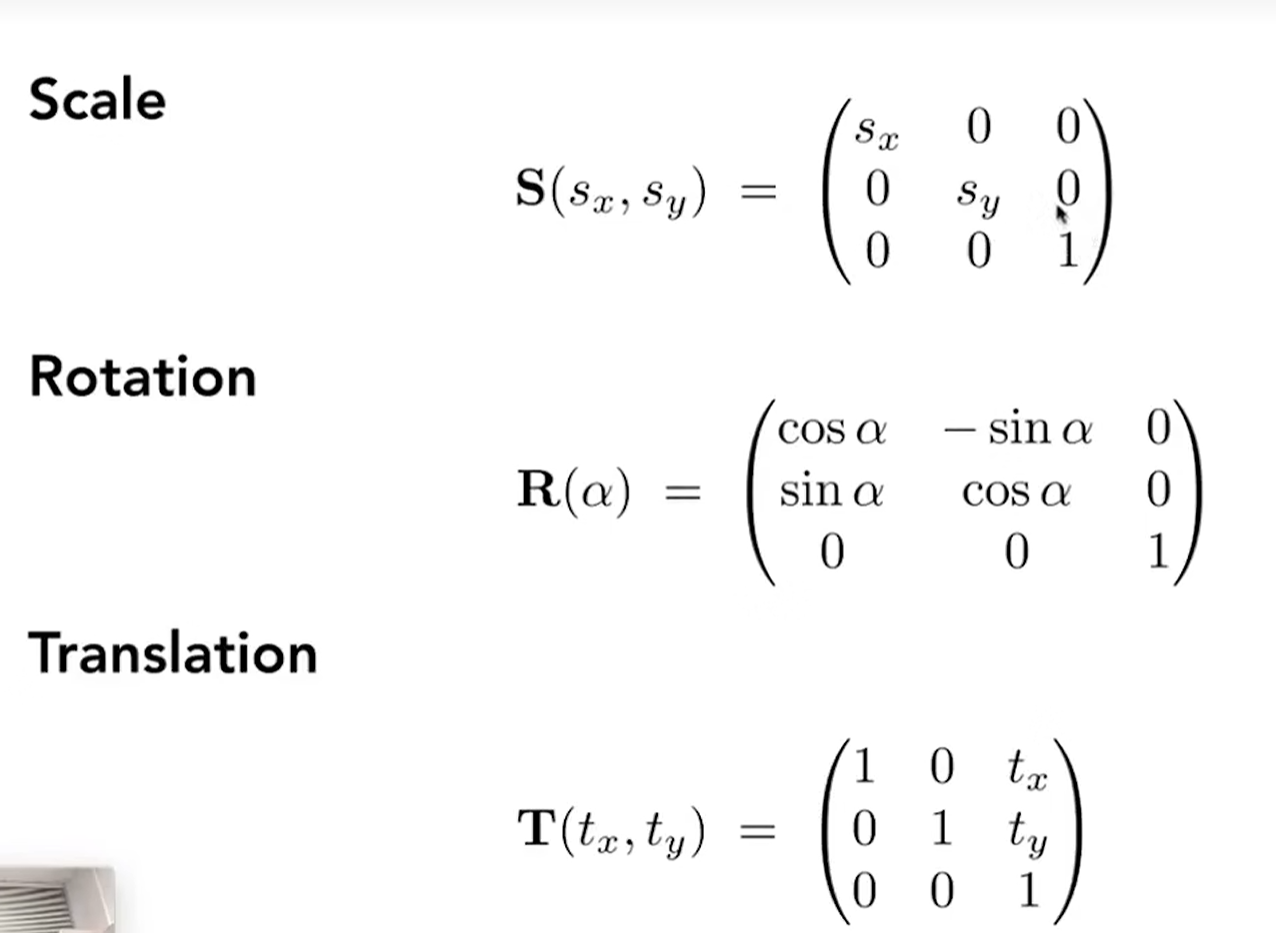

transform

translation

Affine transformner

逆变换

就是逆矩阵

变换的组合

矩阵的乘法

变换的分解

- 变换到中心

- 旋转

- 变换回原始位置

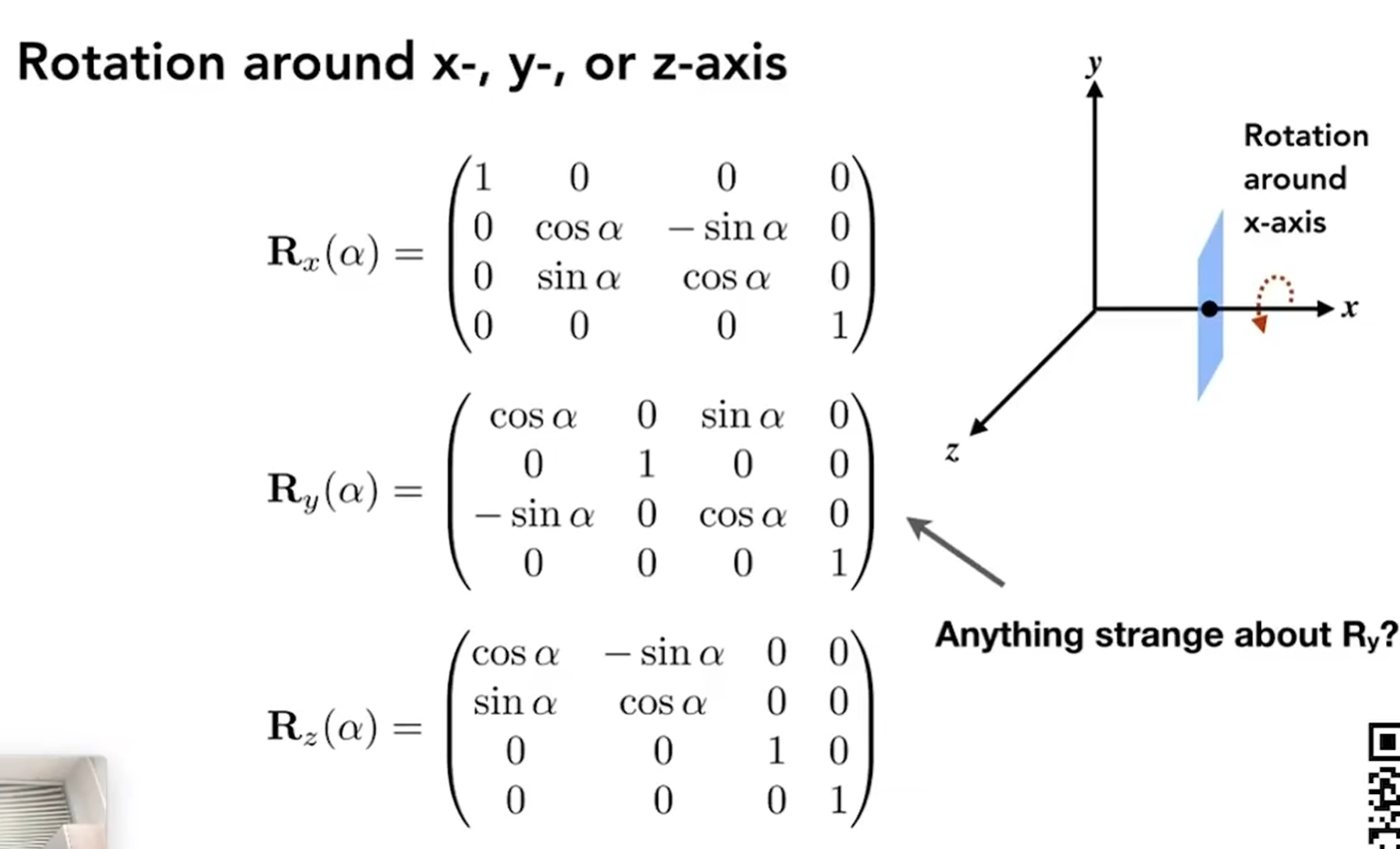

三维

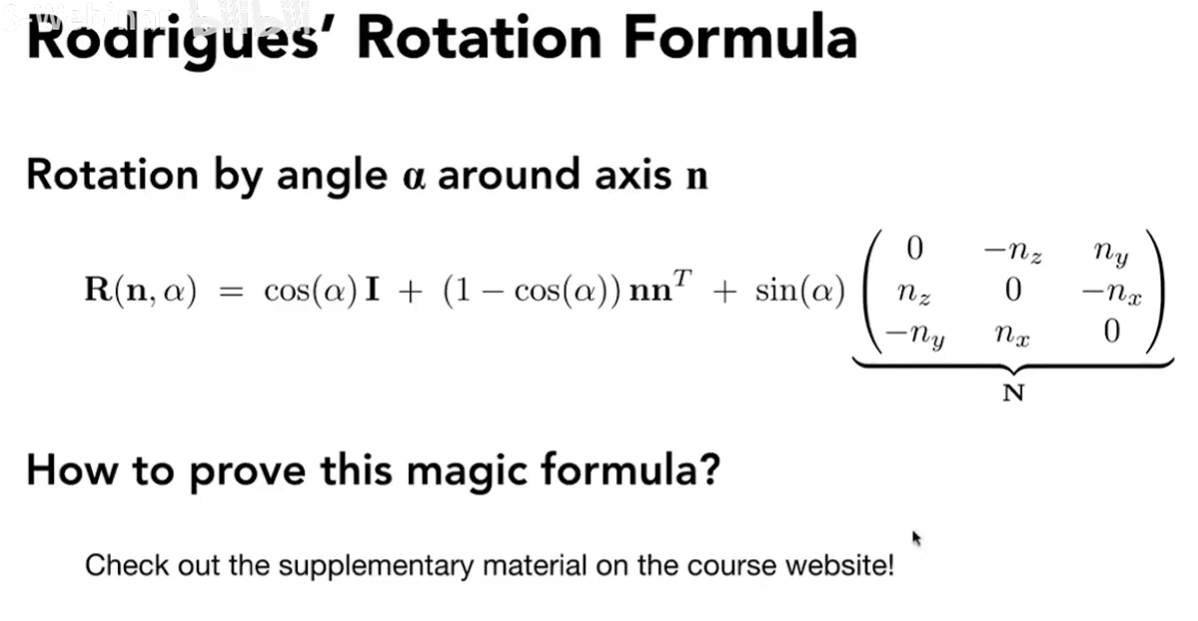

3D 旋转

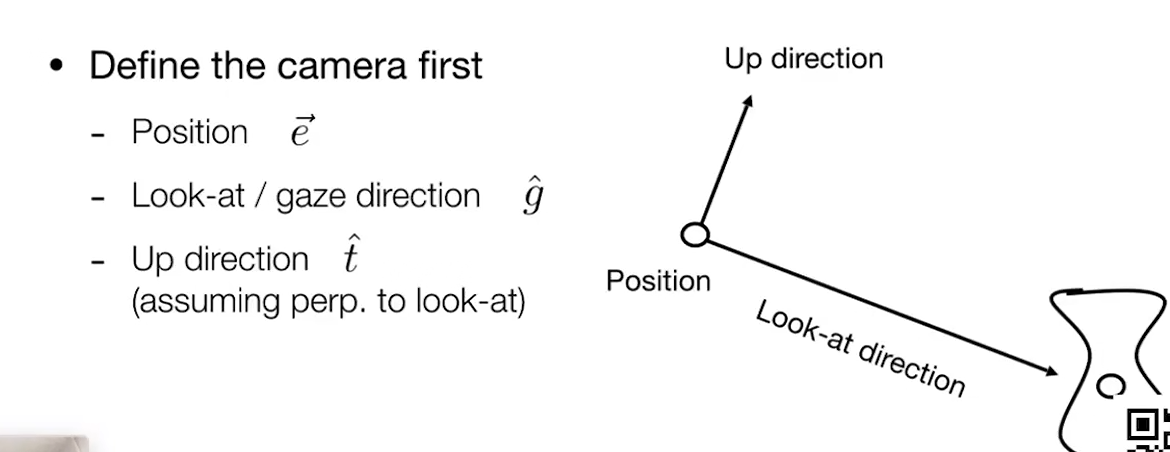

view transformation

- model transform

- view transform

- projection transform

关键特征:

- 如果相机和物体同时移动,则 效果相同

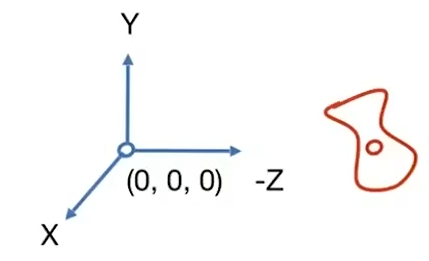

- 约定

- 相机永远在原点

- 看向 -z

- Y轴为向上方向

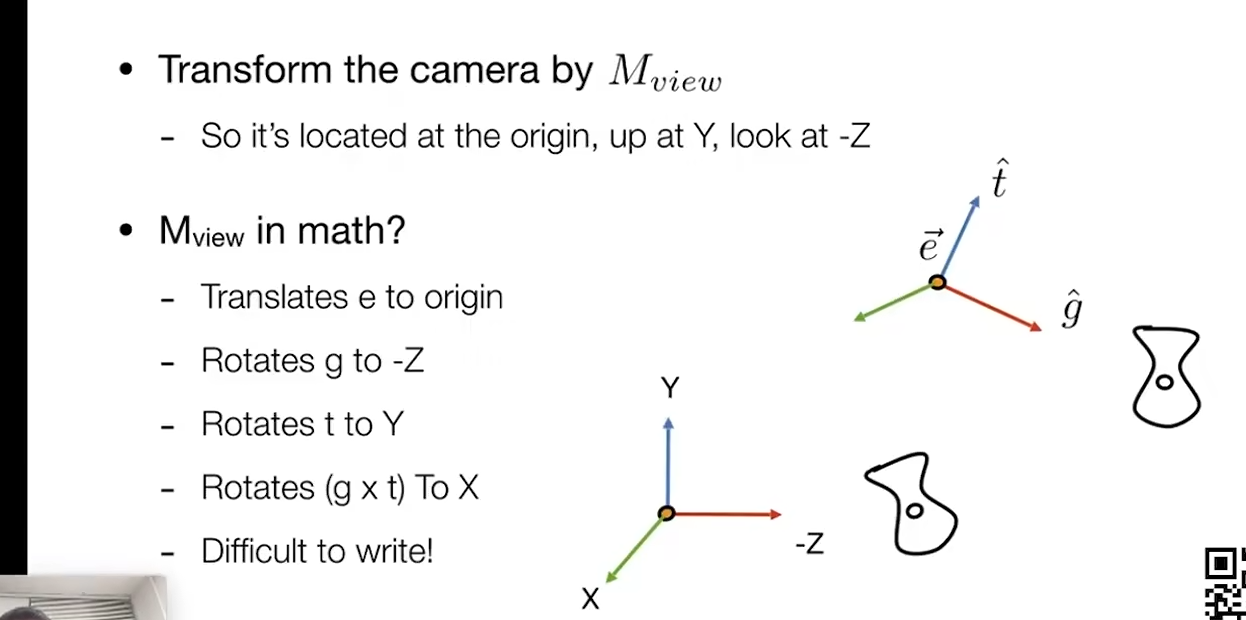

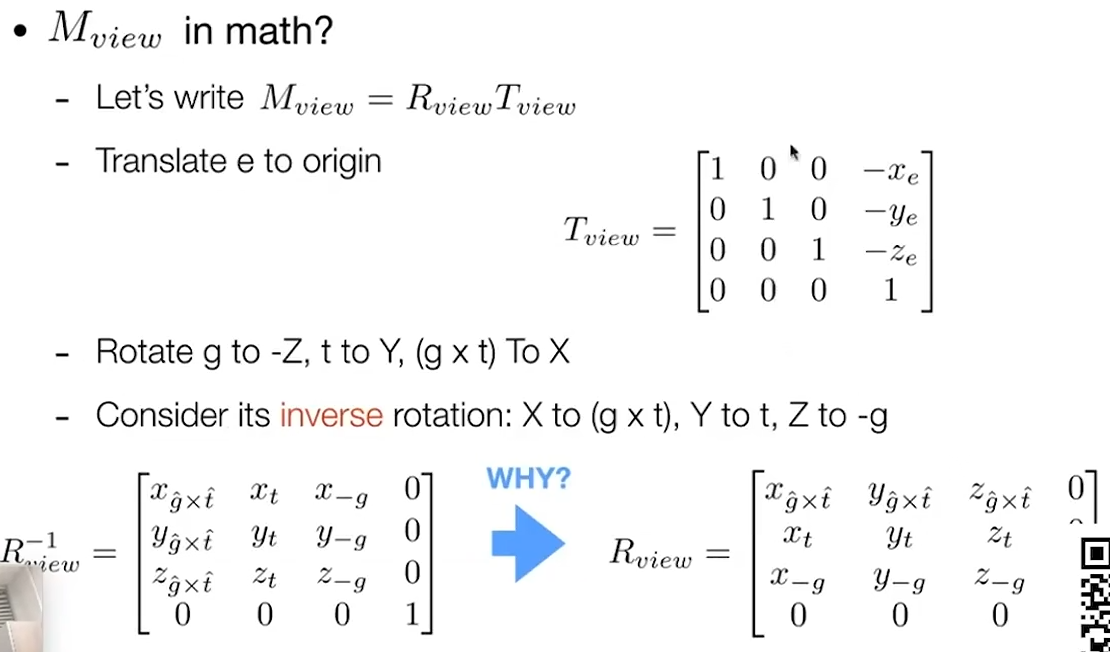

Model --- $M_{view}$ --- 将相机移动到原点

先求逆的旋转 再求逆变换。

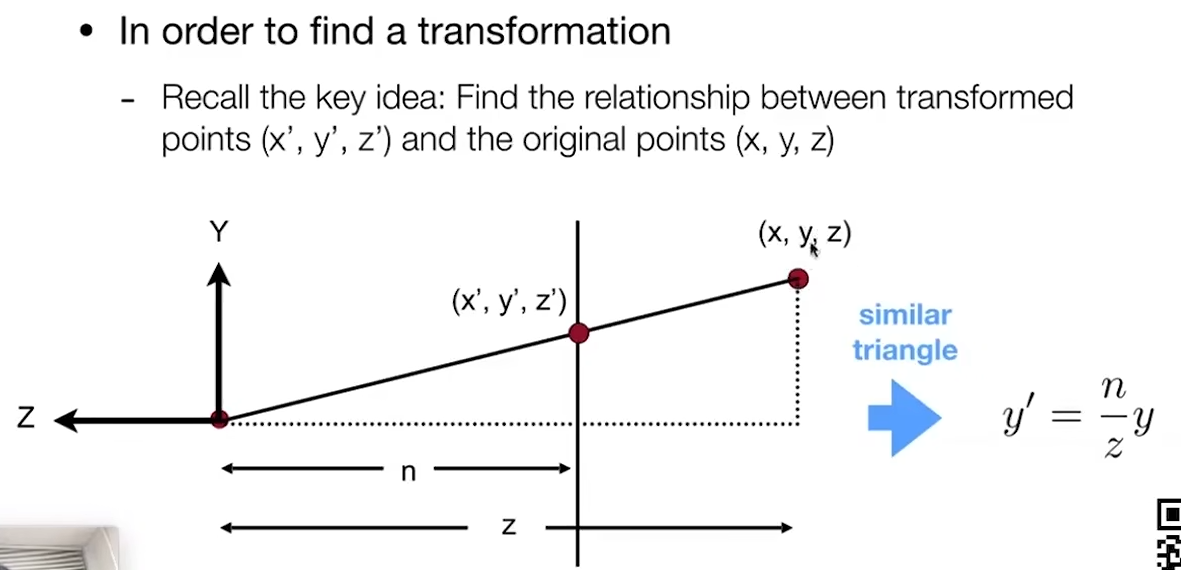

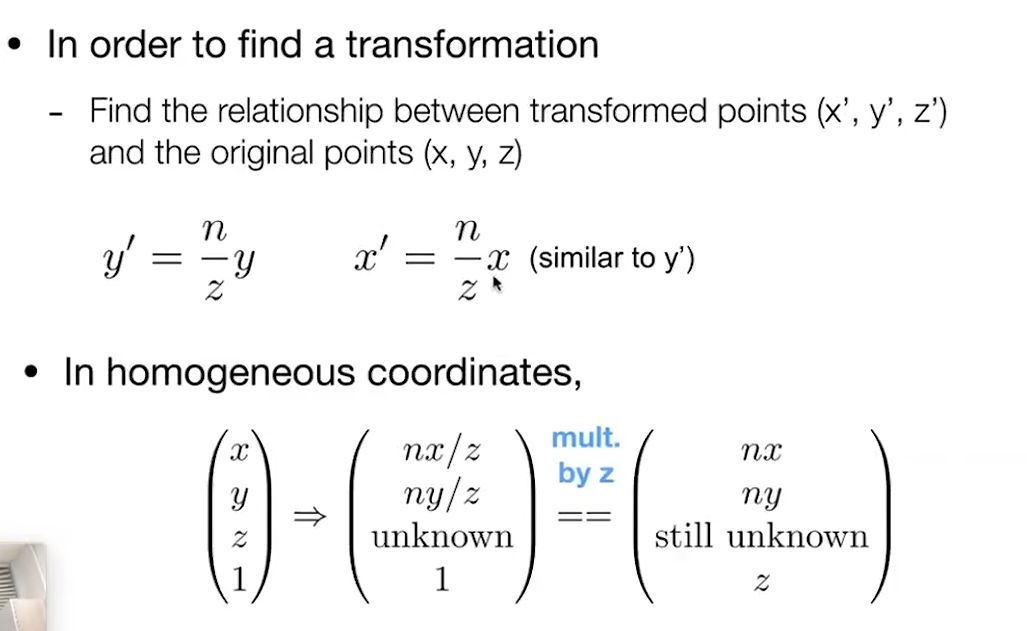

投影

从三维到二维

两种投影

-

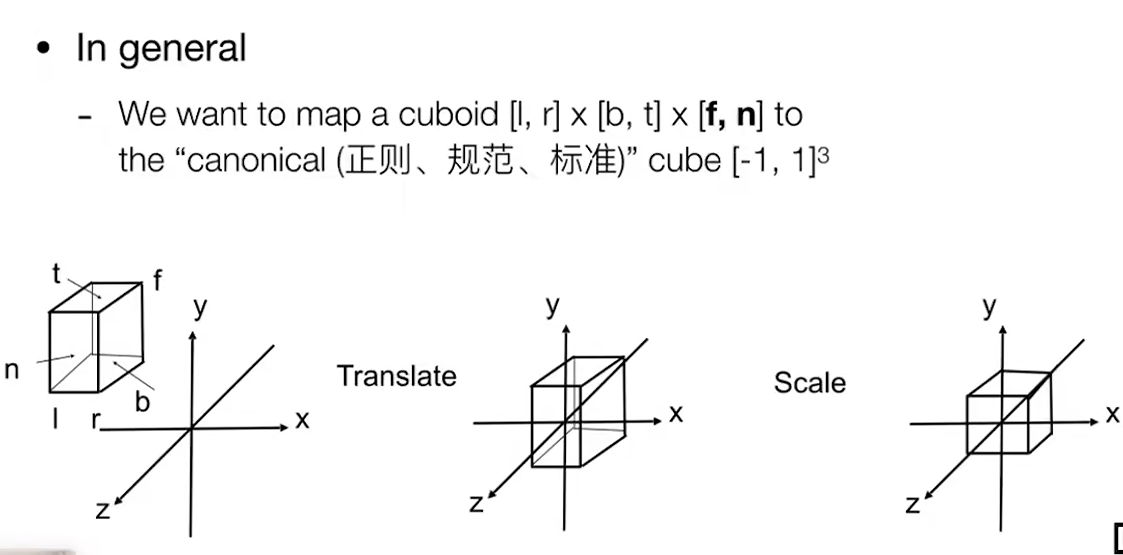

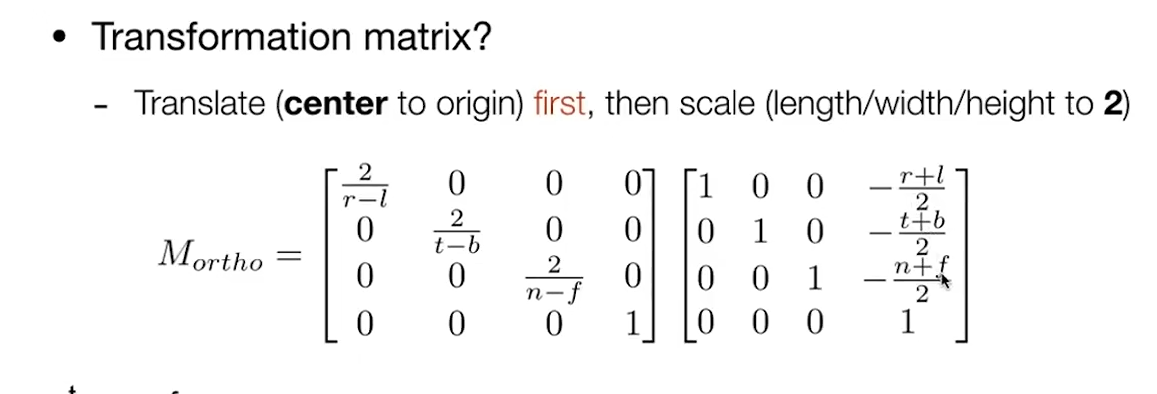

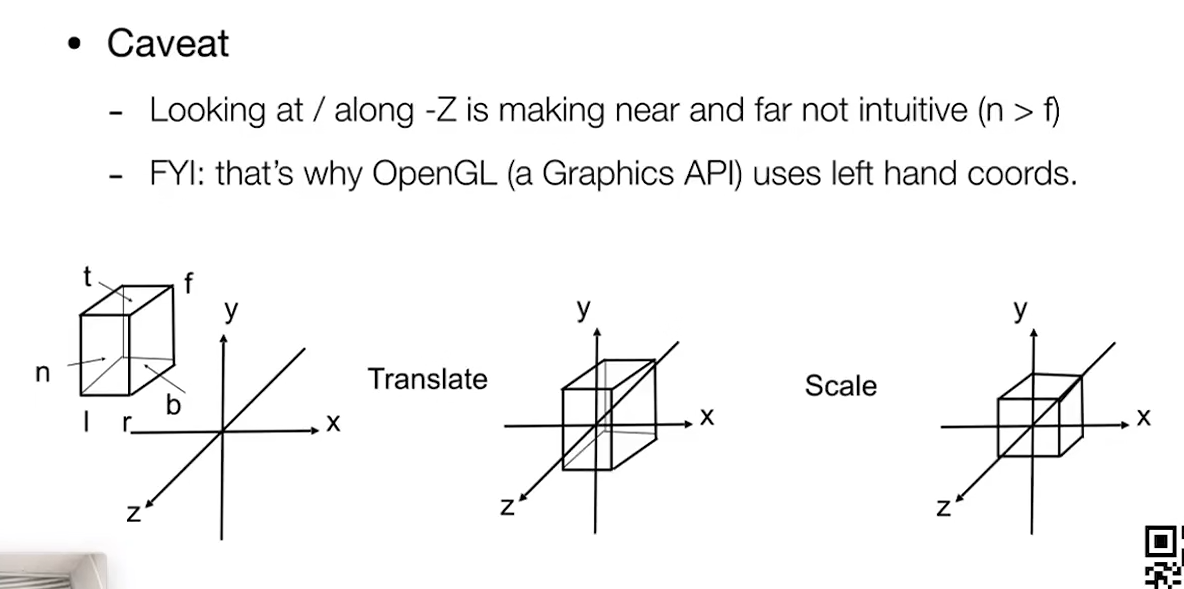

正交投影

-

透视投影 -- 近大远小

-

约定

- 人在画面的 z方向,面向 -z

正交投影

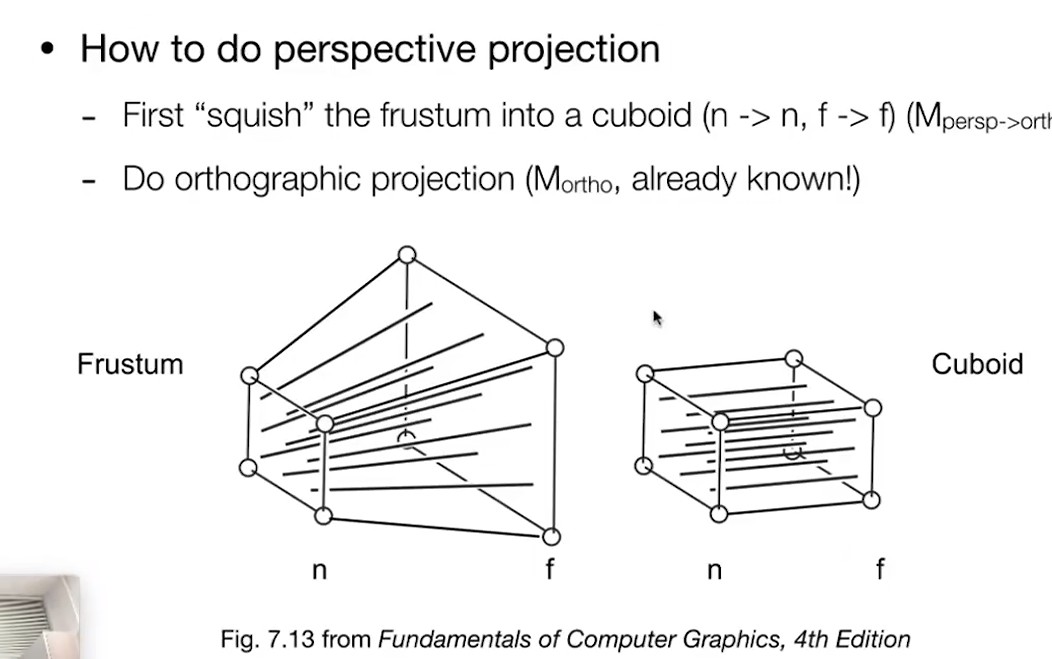

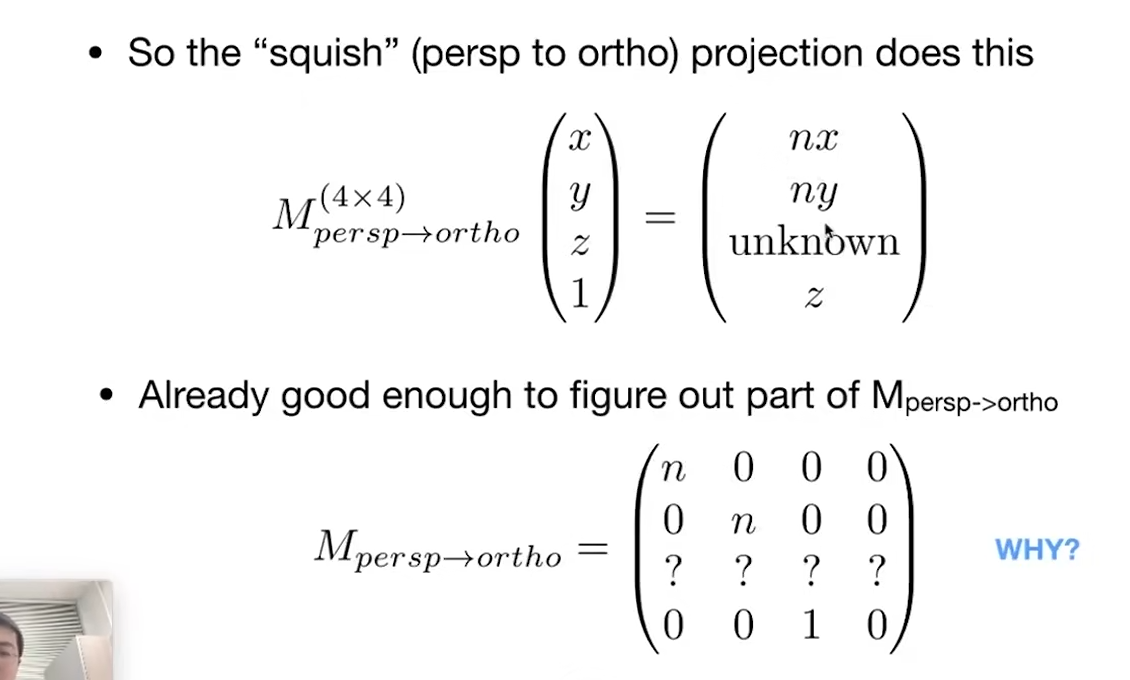

透视投影

- 平行的线不再平行

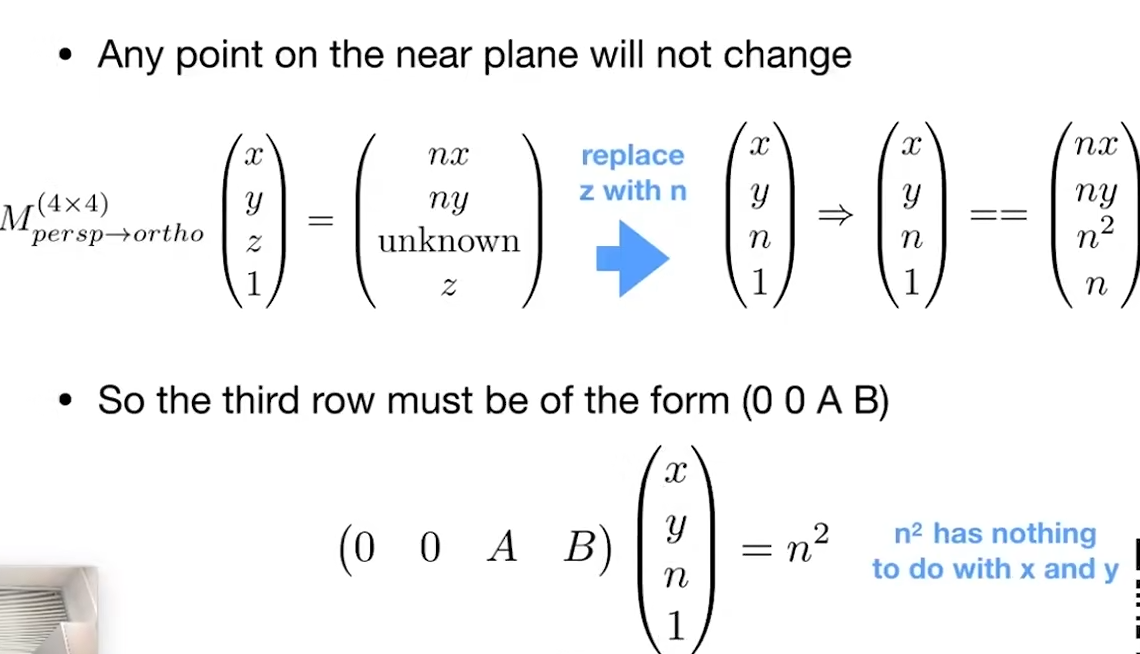

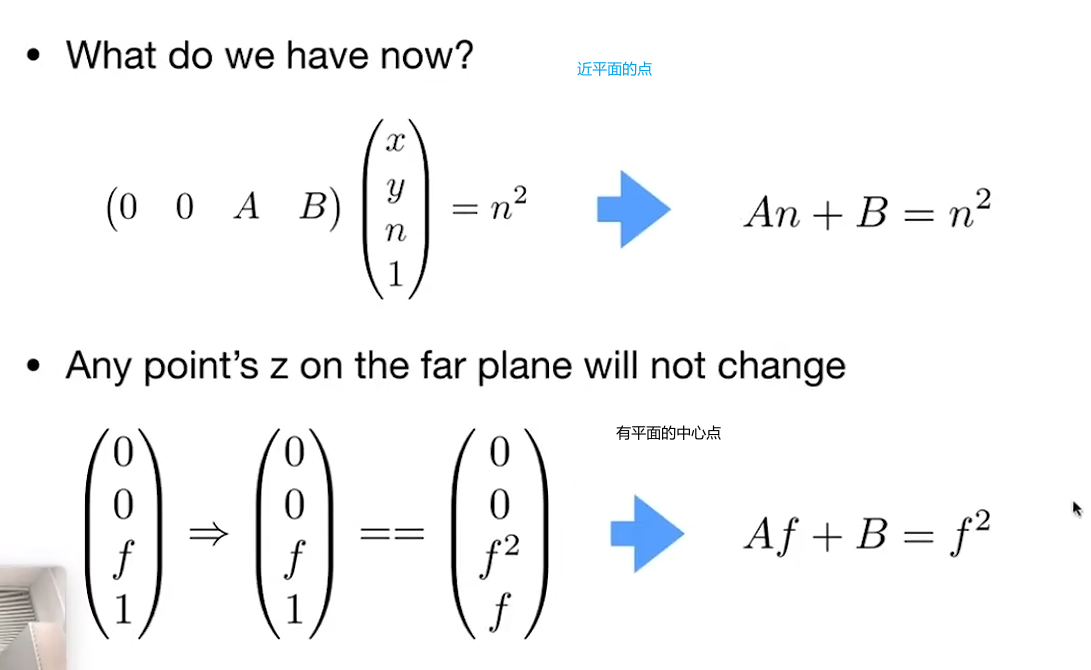

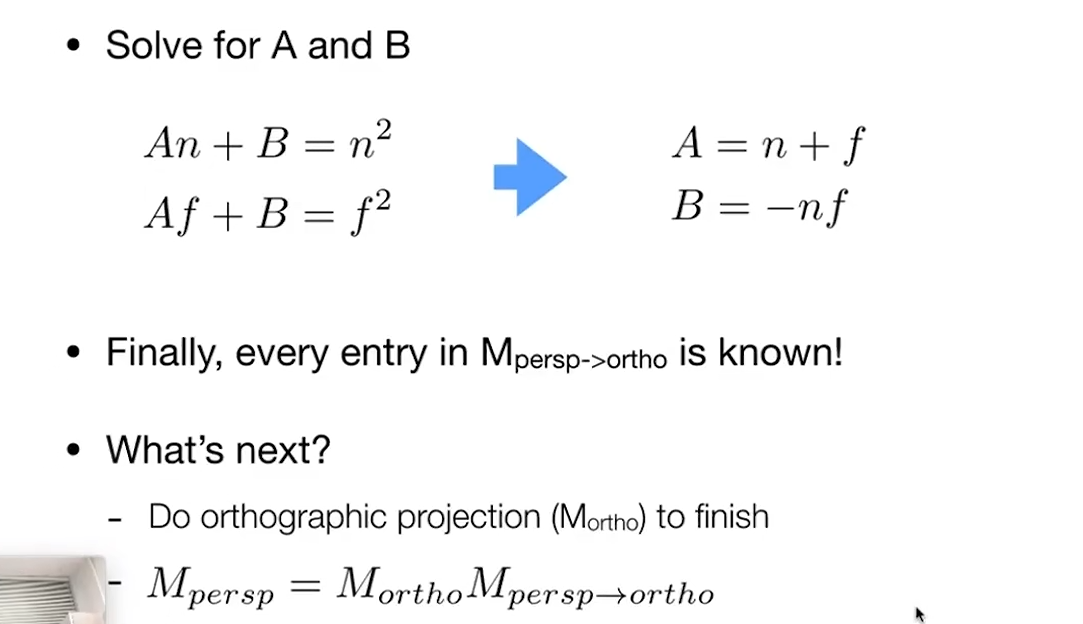

z点的变换

- any point on the near plane will not change

- any point's z on the far plane will not change

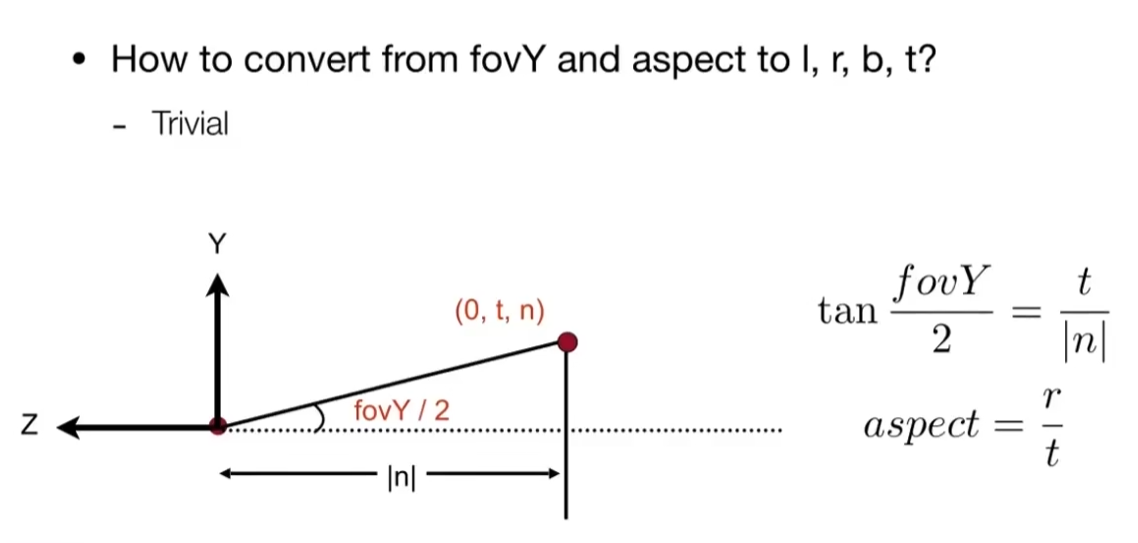

fov -- 可视角度 -- 分x和y