LLM自我改进的典型范式是在自生成数据上训练LLM,但是其中的部分数据可能有害,所以应该被过滤掉。但是目前的工作主要采用基于答案正确性的过滤策略,在这篇论文中,证明过滤掉正确但具有高分布偏移程度(DSE)的样本也可以有利于自我改进的结果。

论文的主要贡献如下:

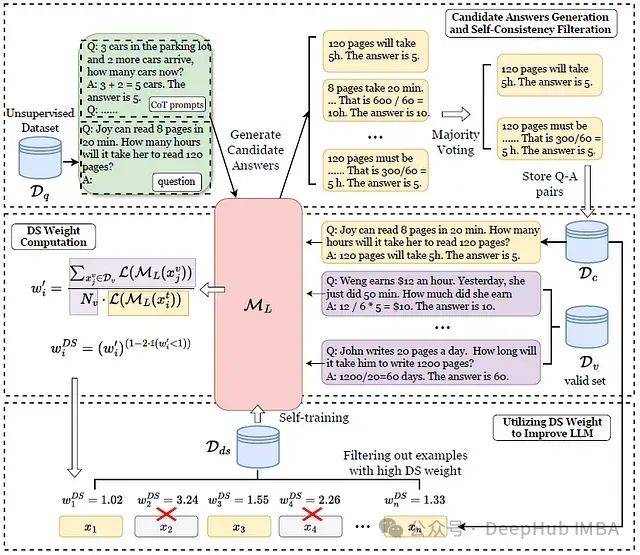

- 提出了一个称为DS权重的指标,借助一个微小的有效集来近似LLM自生成数据的DSE

- 利用DS权重,构建了一个新颖的自我改进框架,称为基于重要性加权的自我改进(IWSI),其中过滤策略同时考虑了答案正确性和DSE

- 实证检验了论文提出方法的有效性,分析了高DSE样本对LLM自我改进的影响,并探讨了DS权重如何与其他过滤标准相互作用

方法论

给定一个无监督(仅问题)数据集D

标签:加权,IWSI,自我,过滤,偏移,LLM,DSE,DS From: https://www.cnblogs.com/deephub/p/18375523