支持能力

https://arxiv.org/pdf/2402.06196

能力增强方法

当我们谈论大模型时,应该关注哪些新能力?

https://www.thepaper.cn/newsDetail_forward_22829654

能力一:涌现能力(emergent abilities)

涌现能力指的是在小型模型中并不存在,但在大模型中“突然出现”的能力,其中包括常识推理、问答、翻译、数学、摘要等(详见下图)。如果仅依靠小型模型的能力做线性外推,往往无法预测出涌现能力的出现和其强度。OpenAI的首席技术官Ilya Sutskever在接受采访时反复强调,尽管表面上看来,语言模型只是在预测下一个词元(token),但当模型足够大,transformer技术的建模能力足够强时,基于内部表示的推理能力就会出现。因此,模型会呈现出与规模较小时完全不同的行为,涌现全新的能力。

涌现能力之所以重要,不仅因为它们是大模型出现后才有的新能力,而且由大模型涌现出来的多数是非常重要的能力。例如,常识推理能力一直是AI领域的重大难题,而大模型的出现使得常识推理取得了重大进展。此外,大模型还有机会进一步获得更多能力。例如,一旦“推理”能力涌现,“思维链提示”(Chain of Thought Prompting)策略就可以用来解决多步推理的难题。因此,涌现能力的出现,是大模型带来的一项根本性变化。

02

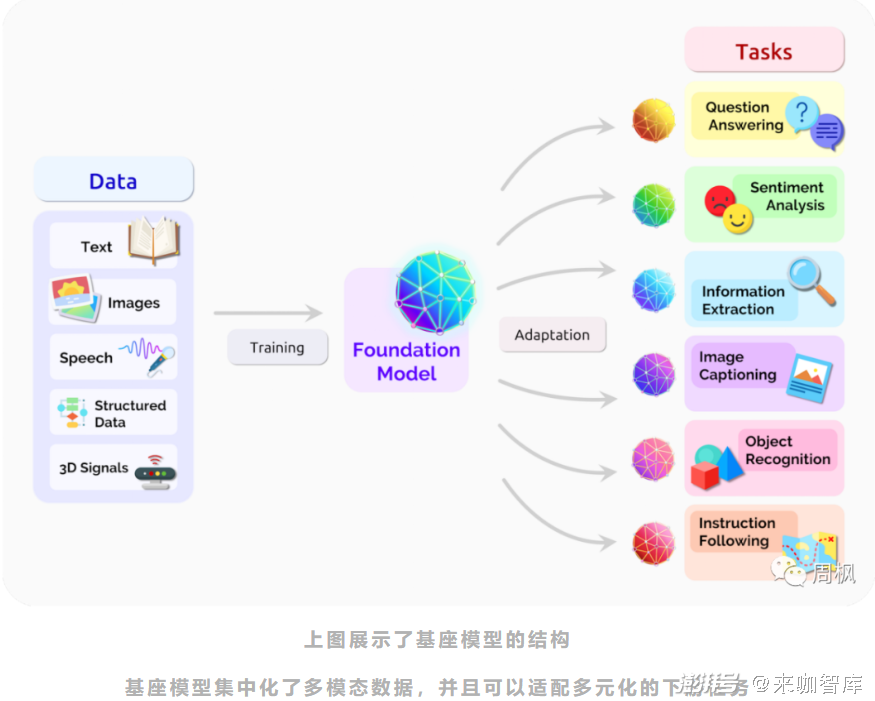

能力二:作为基座模型支持多元应用的能力

在2021年,斯坦福大学等多所高校的研究人员提出了基座模型(foundation model)的概念,这更清晰地描述了之前学界所称的预训练模型的作用。这是一种全新的AI技术范式,借助于海量无标注数据的训练,获得可以适用于大量下游任务的大模型(单模态或者多模态)。这样,多个应用可以只依赖于一个或少数几个大模型进行统一建设。

大语言模型是这个新模式的典型例子,使用统一的大模型可以极大地提高研发效率,相比于分散的模型开发方式,这是一项本质上的进步。大型模型不仅可以缩短每个具体应用的开发周期,减少所需人力投入,也可以基于大模型的推理、常识和写作能力,获得更好的应用效果。因此,大模型可以成为AI应用开发的大一统基座模型,这是一个一举多得、全新的范式,值得大力推广。

03

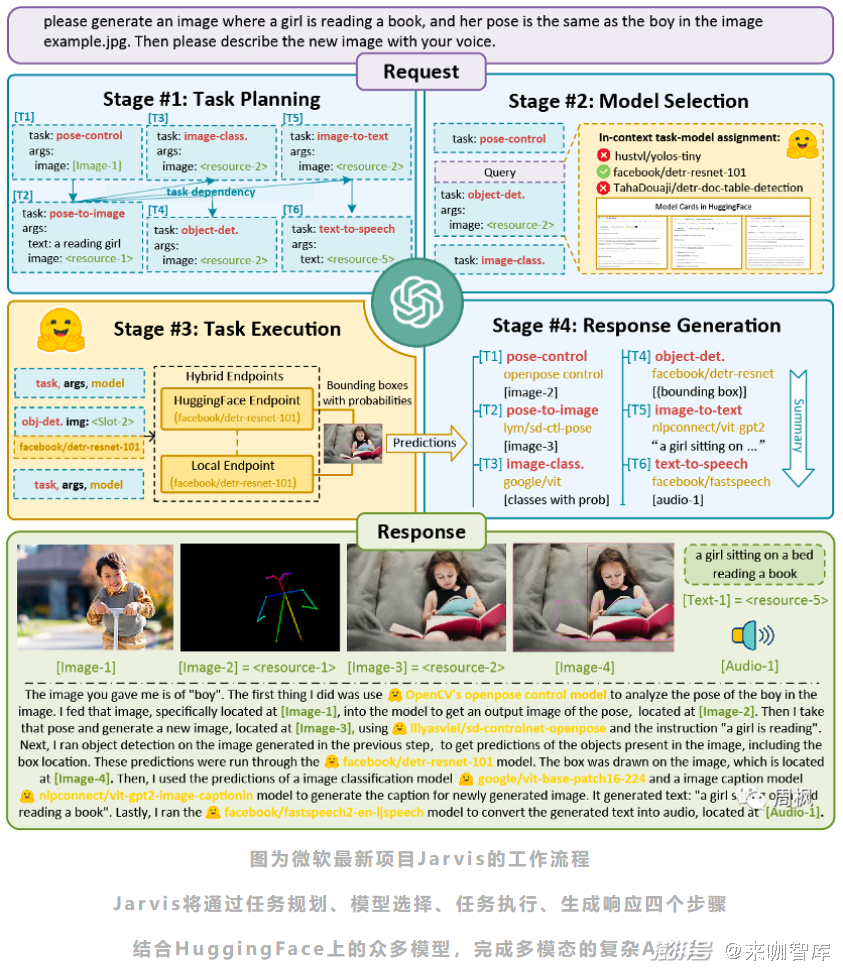

能力三:支持对话作为统一入口的能力

让大语言模型真正火爆的契机,是基于对话聊天的ChatGPT。事实上,业界很早就发现了用户对于对话交互的特殊偏好,陆奇在微软期间2016年就推进“对话即平台(conversation as a platform)”的战略。此外,苹果Siri、亚马逊Echo等基于语音对话的产品也非常受欢迎,反映出互联网用户对于聊天和对话这种交互模式的偏好。虽然之前的聊天机器人存在各种问题,但大型语言模型的出现再次让聊天机器人这种交互模式可以重新想像。用户愈发期待像钢铁侠中“贾维斯”一样的人工智能,无所不能、无所不知。这引发我们对于智能体(Agent)类型应用前景的思考,Auto-GPT、微软Jarvis等项目已经出现并受到关注,相信未来会涌现出很多类似的以对话形态让助手完成各种具体工作的项目。

随着大型语言模型技术越来越受欢迎,我们可以期待它带来更多的惊喜,特别是考虑到上面讨论的这些大型模型带来的关键新能力,周明等人所预测的语言智能黄金十年(2020-2030)很可能会成为现实,这正是一个令人兴奋的时代。

LLM 用例

https://www.ibm.com/cn-zh/topics/large-language-models

以下是 LLM 为组织带来益处的一些最重要的领域:

文本生成:语言生成能力,如根据提示撰写电子邮件、博客文章或其他中长篇内容,并加以提炼和润色。检索增强生成 (RAG) 就是一个很好的例子。

内容摘要:将长文章、新闻报道、研究报告、公司文档甚至客户历史记录汇总成根据输出格式定制长度的完整文本。

AI 助手:聊天机器人,可以回答客户询问、执行后端任务并以自然语言提供详细信息,作为集成式自助客户服务解决方案的一部分。

代码生成:帮助开发人员构建应用程序,查找代码中的错误并发现多种编程语言中的安全问题,甚至在它们之间进行“翻译”。

情感分析:分析文本,确定客户的语气,以便大规模了解客户反馈并帮助进行品牌声誉管理。

语言翻译:通过流畅的翻译和多语言功能,为各语言和地域的组织提供更广泛的覆盖范围。

标签:语言,AI,模型,能力,对话,支持,涌现 From: https://www.cnblogs.com/lightsong/p/18407394