L2正则化和权重衰退(Weight Decay)

一、权重衰退介绍

1.什么是权重衰减/权重衰退——weight_decay

-

L2正则化

-

主要作用是:解决过拟合,在损失函数中加入L2正则化项

2. L2范数

L2范数,也被称作欧几里得范数或者Frobenius范数(当应用于矩阵时),是最常用的向量范数之一,用于衡量向量元素的大小。在数学上,L2范数定义为向量元素的平方和的平方根。对于向量\(x = [x_1,x_2,...,x_n]\) ,其L2范数可以表示为:

\[||x||_2 = \sqrt{x_1^2+x_2^2+...+x_n^2} \]weight _decay本质上是一个 L2正则化系数

3 .L2正则化

在数学表达式中,L2正则化通常被表达为损失函数的一个额外组成部分,如下所示:

\[Loss_{total} = Loss_{data} + \dfrac{\lambda}{2}||w||^2 \]其中:

- \(Loss_{total}\) 是模型在数据上的原始损失。

- \(\lambda\)是L2正则化系数,用于控制正则项对总损失的贡献程度。

- \(||w||^2\) 是权重向量\(w\)的L2范数的平方。

weight _decay本质上是一个 L2正则化系数

可以理解为:

- 加上这个 L2正则化,会限制模型的权重都会趋近于0

- 理解就是当

w趋近 0 时,w平方和 会小, 模型损失也会变小 - 而

weight_decay的大小就是公式中的λ,可以理解为λ越大,优化器就越限制权重变得趋近 0

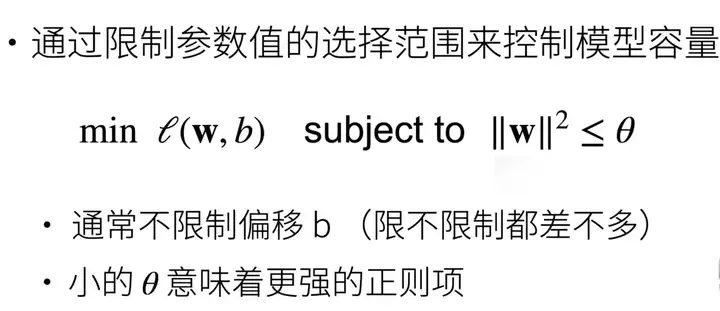

4 范数的限制

范数的限制有两种,一种是硬性限制,第二种是柔性限制。

硬性限制:

我们如何控制一个模型的容量呢?

- 选择的参数比较少

- 使得每个参数选择的值的范围比较小

而我们的权重衰退就是通过限制参数值的选择范围来控制模型的容量的。

我们增加限制,限制w:如下图所示,w向量中每一个元素的值都小于θ的根号。

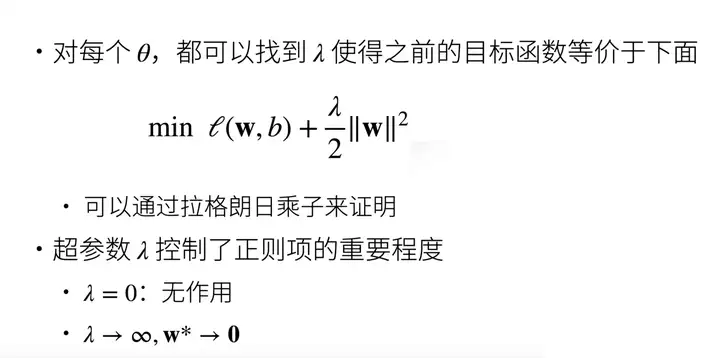

柔性限制(常用):

λ是一个平滑的,不像硬性限制,这种方法不会强制要求模型参数在每一步更新时都严格满足约束条件,而是通过在损失函数中加入一个与范数成比例的正则化项来进行折衷。

拉格朗日乘子法原本是用于解决约束条件下的多元函数极值问题。举例,求f(x,y)的最小值,但是有约束C(x,y) = 0。乘子法给的一般思路是,构造一个新的函数g(x,y,λ) = f(x,y) +λC(x,y),当同时满足g'x = g'y = 0时,函数取到最小值。这件结论的几何含义是,当f(x,y)与C(x,y)的等高线相切时,取到最小值。

具体到机器学习这里,C(x,y) = w^2 -θ。所以图中的黄色圆圈,代表不同θ下的约束条件。θ越小,则最终的parameter离原点越近。

5. 演示柔性限制对最优解的影响

① 绿色的线就是原始损失函数l的等高线,优化原始损失l的最优解(波浪号即最优解)在中心位置。

② 黄色圆圈,代表不同θ下的约束条件。θ越小,则最终的parameter离原点越近。

③ 当原始损失加入二分之λ的项后,这个项是一个二次项,假如w就两个值,x1(横轴)、x2(纵轴),那么在图上这个二次项的损失以原点为中心的等高线为橙色的图所示。所以合并后的损失为绿色的和黄色的线加一起的损失。

④ 当加上损失项后,可以知道原来最优解对应的二次项的损失特别大,因此原来的最优解不是加上二次项后的公式的最优解了(因为原始最优解对于我们的损失项(黄线)来说就会特别大)。若沿着橙色的方向走,原有l损失值会大一些,但是二次项罚的损失会变小,当拉到平衡点以内时,惩罚项减少的值不足以原有l损失增大的值,这样w * 就是加惩罚项后的最优解。

⑤ 损失函数加上正则项成为目标函数,目标函数最优解不是损失函数最优解。正则项就是防止达到损失函数最优导致过拟合,把损失函数最优点往外拉一拉。鼓励权重分散,将所有额特征运用起来,而不是依赖其中的少数特征,并且权重分散的话它的内积就小一些。

⑥ l2正则项会对大数值的权值进行惩罚。

6.参数更新法则

推导过程:

带有正则化的损失函数的一般形式是:\(L = l(w,b) + \dfrac{\lambda}{2}||w||^2\)

其中:

- \(l(w,b)\)是原始损失函数

- \(\dfrac{\lambda}{2}||w||^2\)是L2正则项,也被称为权重衰减项,用来对大的权重值进行惩罚,避免过拟合。

- \(\lambda\)是正则化系数,控制着正则化项的强度。

进行梯度下降时,目标是找到使损失函数\(L\)最小的\(w\)。求\(L\)对\(w\)的偏导数,得到:

\[\dfrac{\partial{L}}{\partial{w}} = \dfrac{\partial{l(w,b)}}{\partial{w}}+\lambda w \]更新权重\(w\)的规则是从当前权重减去学习率乘以这个梯度,因此得到未加括号的具体更新步骤:

\[w_{t+1} = w_t - \eta( \dfrac{\partial{l(w_t,b)}}{\partial{w_t}}+\lambda w_t)\\ w_{t+1} = (1-\eta\lambda)w_t - \eta\dfrac{\partial{l(w_t,b)}}{\partial{w_t}} \]注意,这里\(1-\eta\lambda\)部分,因为 \(\eta\lambda<1\),起到了缩减当前权重值的作用,这个操作也就是所谓的权重衰减。

总结

- 权重衰退通过L2正则项使得模型参数不会过大,从而控制模型复杂度

- 正则项权重是控制模型复杂度的超参数

二、代码部分

1. 权重衰退(使用自定义)

① 权重衰退是最广泛使用的正则化的技术之一。

② 像以前一样生成一些数据(人工数据集):\(y = 0.05+\sum_{i = 1}^d0.01x_i+\epsilon where\epsilon \sim N(0,0.01^2)\)

%matplotlib inline

import torch

from torch import nn

from d2l import torch as d2l

n_train, n_test, num_inputs, batch_size = 20, 100, 200, 5 # 数据越简单,模型越复杂,越容易过拟合。num_inputs为特征维度

true_w, true_b = torch.ones((num_inputs,1)) * 0.01, 0.05

train_data = d2l.synthetic_data(true_w, true_b, n_train) # 生成人工数据集

train_iter = d2l.load_array(train_data, batch_size)

test_data = d2l.synthetic_data(true_w, true_b, n_test)

test_iter = d2l.load_array(test_data, batch_size, is_train=False)

# 初始化模型参数

def init_params():

w = torch.normal(0,1,size=(num_inputs,1),requires_grad=True)

b = torch.zeros(1,requires_grad=True)

return [w,b]

# 定义L2范数惩罚

def l2_penalty(w):

return torch.sum(w.pow(2)) / 2 # 这里我们没有把lambda写进了,我们会写在外面

# 定义训练函数

def train(lambd):

w, b = init_params()

net, loss = lambda X: d2l.linreg(X, w, b), d2l.squared_loss

num_epochs, lr = 100, 0.003

animator = d2l.Animator(xlabel='epoch',ylabel='loss',yscale='log',xlim=[5,num_epochs],legend=['train','test'])

for epoch in range(num_epochs):

for X, y in train_iter:

#with torch.enable_grad():

l = loss(net(X),y) + lambd * l2_penalty(w) # lambda * l2_penalty

l.sum().backward()

d2l.sgd([w,b],lr,batch_size)

if(epoch+1) % 5 == 0:

if(epoch+1) % 5 ==0:

animator.add(epoch + 1, (d2l.evaluate_loss(net, train_iter, loss), d2l.evaluate_loss(net,test_iter,loss)))

print('w的L2范数是',torch.norm(w).item())

help(d2l.synthetic_data) # 查看函数用法

Help on function synthetic_data in module d2l.torch:

synthetic_data(w, b, num_examples)

Generate y = Xw + b + noise.

忽略正则化直接训练:

# 忽略正则化直接训练

train(lambd=0) # 训练集小,过拟合,测试集损失不下降

使用权重衰退:

# 使用权重衰退

train(lambd=3)

2.权重衰退(使用框架)

# 简洁实现

def train_concise(wd):

net = nn.Sequential(nn.Linear(num_inputs,1))

for param in net.parameters():

param.data.normal_()

loss = nn.MSELoss()

num_epochs, lr = 100, 0.003

trainer = torch.optim.SGD([{"params":net[0].weight,"weight_decay":wd},{"params":net[0].bias}],lr=lr) # 惩罚项既可以写在目标函数里面,也可以写在训练算法里面,每一次在更新之前把当前的w乘以衰退因子weight_decay

animator = d2l.Animator(xlabel='epoch',ylabel='loss',yscale='log',xlim=[5,num_epochs],legend=['train','test'])

for epoch in range(num_epochs):

for X, y in train_iter:

with torch.enable_grad():

trainer.zero_grad()

l = loss(net(X),y)

l.backward()

trainer.step()

if(epoch + 1) % 5 == 0:

animator.add(epoch + 1, (d2l.evaluate_loss(net, train_iter, loss), d2l.evaluate_loss(net,test_iter,loss)))

print('w的L2范数是',net[0].weight.norm().item())

忽略正则化直接训练:

# 这些图看起来和我们从零开始实现权重衰减时的图相同

train_concise(0)

使用权重衰退::

train_concise(3)