论文阅读03-EFR-DGC:Enhanced Feature Representations for Deep Graph Clustering

论文信息

论文地址:Deep graph clustering with enhanced feature representations for community detection | SpringerLink

论文代码:https://github.com/grcai/DGC-EFR

1.存在问题

- DAEGC在处理拓扑关系 方面取得了成功,但深度图聚类通常无法充分学习节点的属性信息。 节点特征信息学习不足。======图模型通常更关注拓扑信息而忽略节点属性的重要性。

DAEGC 这篇论文中证明了:图注意力网络构建图自动编码器,作为更强大的学习者来提取足够的拓扑信息进行聚类:EFR-DGC 拓扑关系(结构信息): 通过利用DAEGC 中的图注意力机制的编码器,来处理拓扑关系和属性信息融合。

- 结构深度聚类网络(SDCN)和深度融合聚类网络(DFCN)将节点的结构信息整合到深度聚类中,图模型的能力有限以及缺乏足够的模型优化自监督信息,这两者仍然存在特征表示不足的问题:

SDCN这篇论文中证明了:自动编码器,作为来学习层次的属性关系。EFR-DGC 属性关系(节点特征信息): 通过利用SDCN 中的AE编码器,来学习层次的属性关系。

2.EFR-DGC解决问题

提出一种改进的特征表示方法,用于发现社区中的深度图聚类。

- 首先构造一个具有

多个全连接层的基本自动编码器 (AE)来学习层次属性信息, - 然后将

AE学习到的属性信息,其传递给图自动编码器(GAE)的神经层。图自编码器接收到的分层属性信息与其提取的拓扑关系有机地组合,以生成用于聚类的增强的特征表示。 - 其次,

设计了一自监督机制来优化深度图聚类模型,该机制利用两个自动编码器的重构损失和聚类损失作为自监督信息,有效地指导模型更新。这样克服了生成表示中属性信息不足的问题,从而更有利于社区发现。

优点长处:

与 SDCN 和 DFCN 中使用的简单图卷积网络相比,我们的图自动编码器能够通过为相邻节点分配不同的权重来很好地处理它们的属性和拓扑信息

3.模型

1. 模型架构图

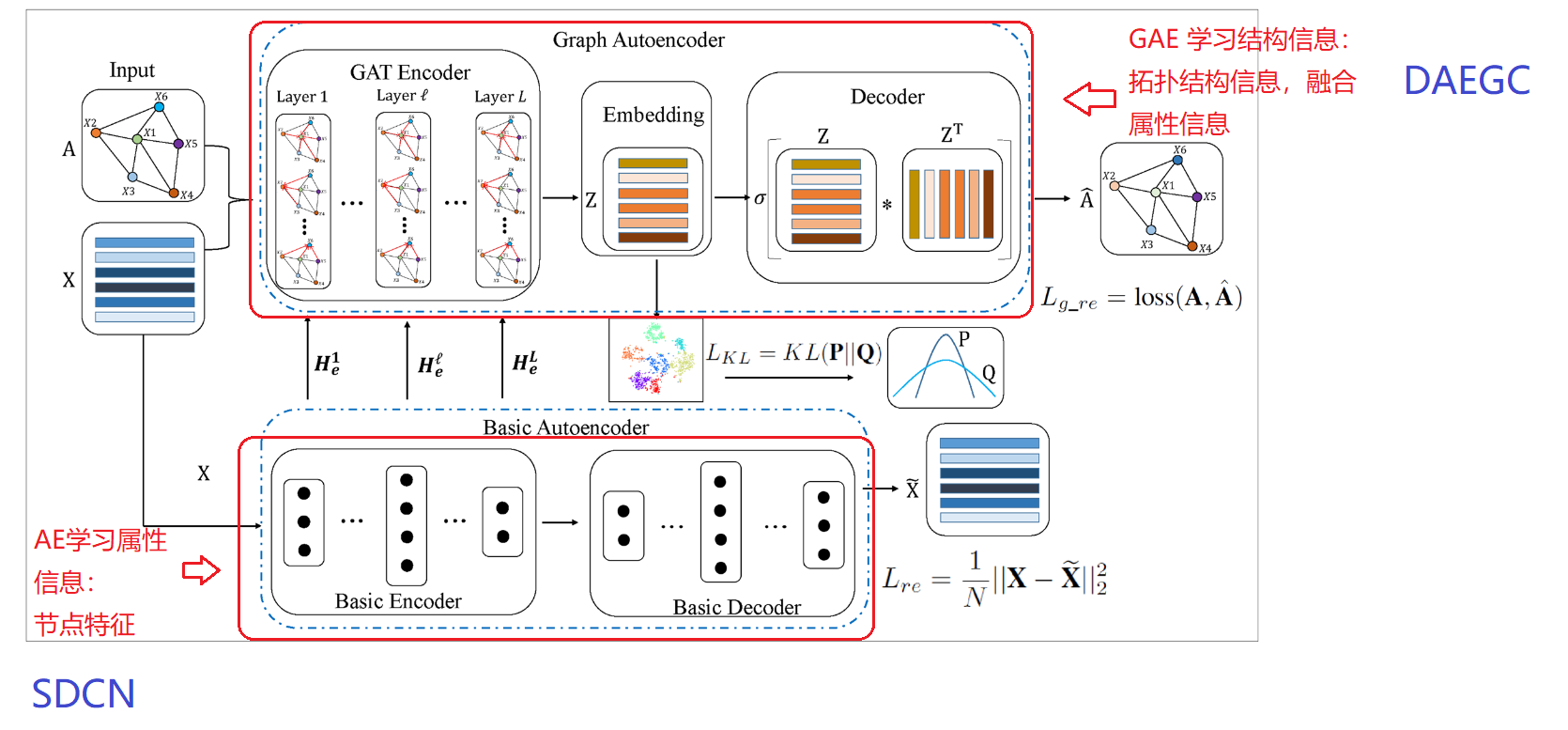

EFR-DGC模型架构 主要由3个模块组成: 学习节点属性信息的基本编码器AE 来自SCDN论文, 学习图的结构信息即拓扑结构信息,并融合属性信息的带有注意力机制的图编码器 来自DAEGC 论文,以及带有自监督的聚类模块**。

2.模型的模块详细介绍

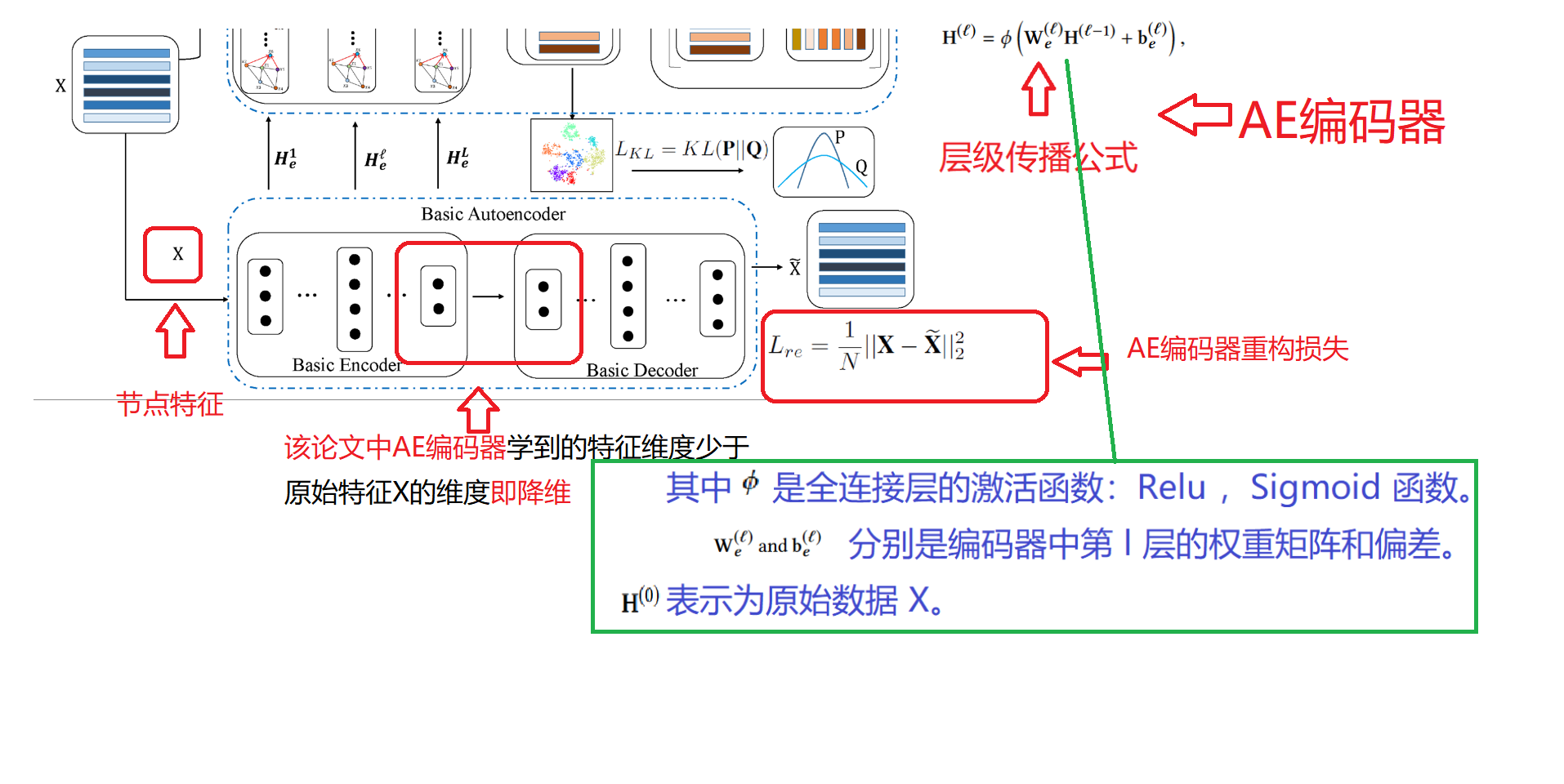

1. AE编码器 学习属性信息

我们使用具有多个全连接层的基本自动编码器 (AE) 从原始特征数据X中学习分层属性信息,并将其学习到的信息嵌入到潜在空间中的紧凑特征表示中和SCDN中论文一模一样。

2.带有注意力机制的GAE

我们通过图注意力网络 (GAT) 构建图自动编码器 (GAE),并将其与基本 AE 相结合以生成增强的特征表示。

- 编码器encoding

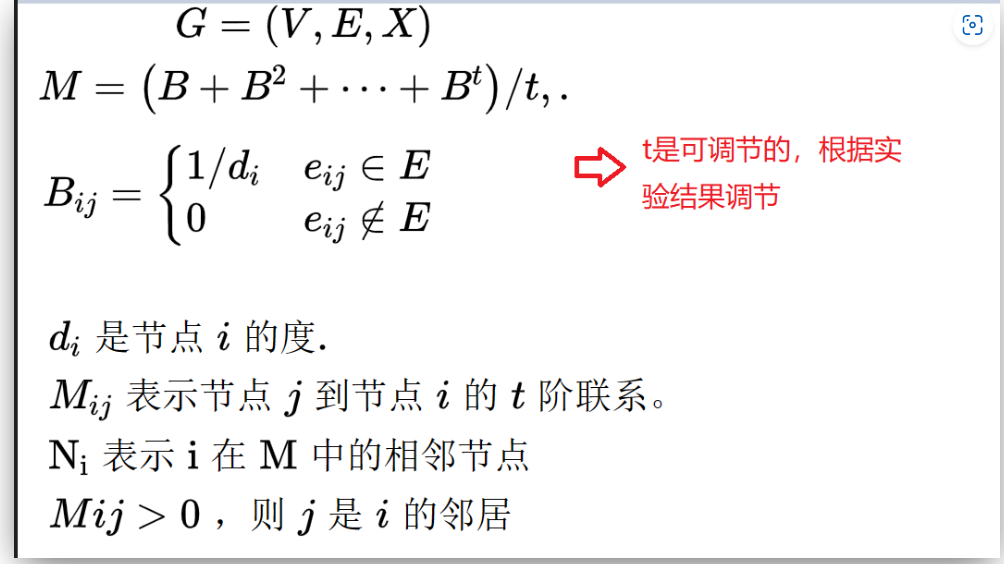

EFR-DGC 认为图具有复杂的结构关系,建议在编码器中利用高阶邻居。我们通过考虑图中的 t 阶邻居节点获得邻近矩阵M: t参数可以根据实验结果,自己调节,也即是输入参数`

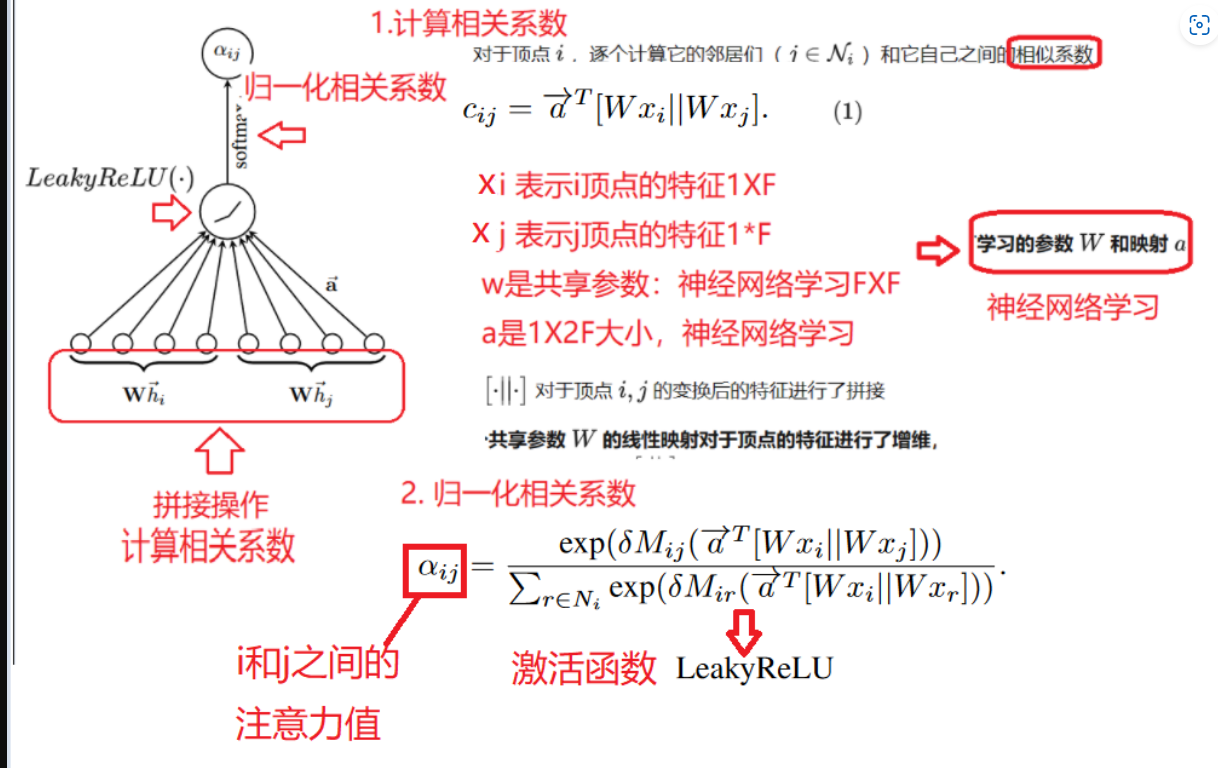

接下来计算顶点之间的图注意力系数: 顶点间的图注意力是不对成的 即 aij 不等于aji

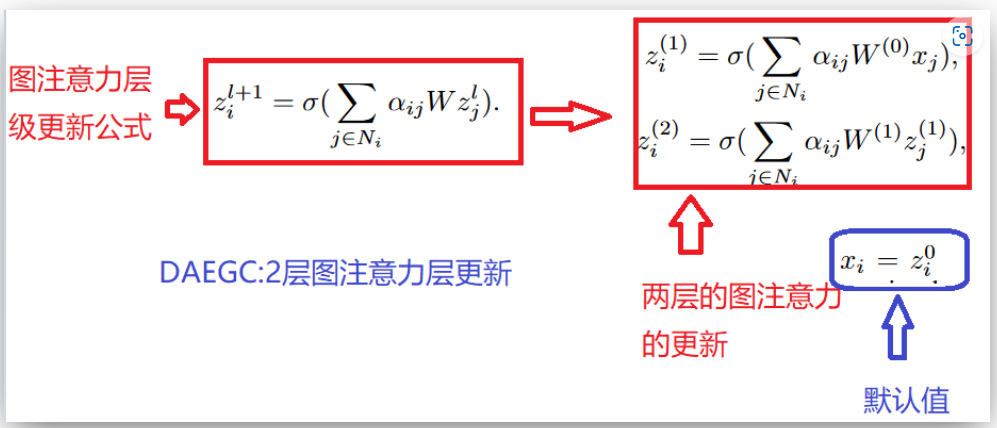

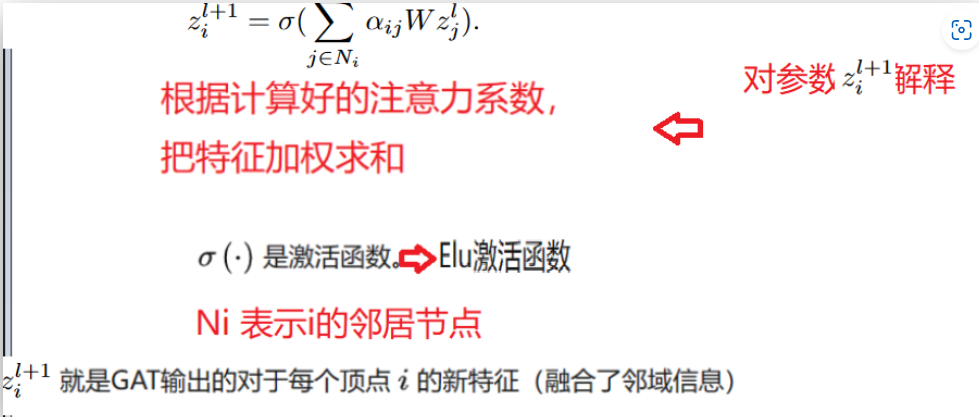

图注意层得到图注意力自动编码器的编码器部分层级更新:

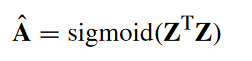

- 解码器decoding

- 损失函数计算

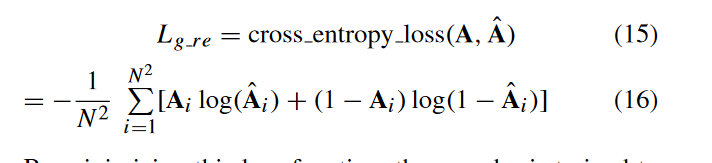

采用交叉熵损失函数:

3. 自监督机制

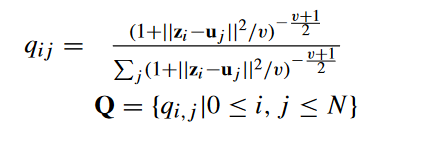

我们使用学生 t 分布 作为函数来计算节点 i 的特征表示 zi 与聚类中心 uj 之间的相似度:聚类中心 u 是用基于 Z 的 K-means 初始化的。

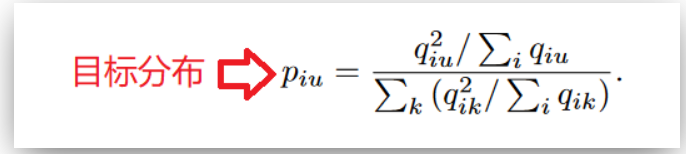

*qiu*表示节点i属于簇u的概率,将其看作是每个节点的软聚类分配标签,如果值越大,那么可信度越高 。通过平方运算将这种可信度放大,

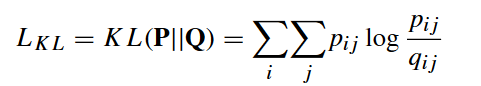

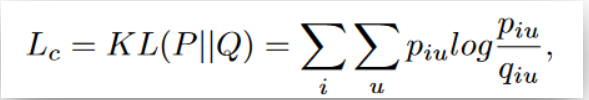

自训练聚类模块的损失函数采用KL 散度:

聚类损失然后迫使当前分布 Q 逼近目标分布 P ,从而将这些“置信分配”设置为软标签来监督 Q 的嵌入学习