RangeNet++方法

-

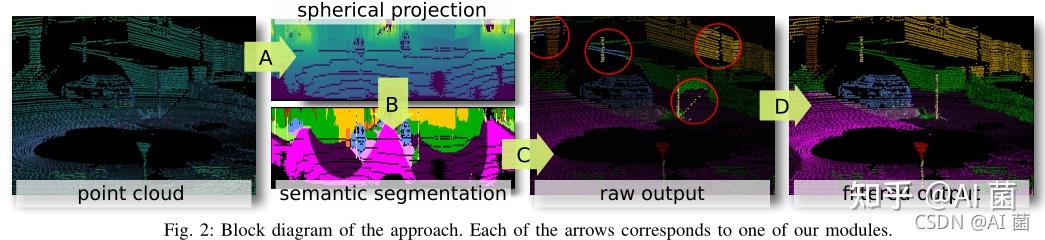

(A)将输入点云转换为距离图像表示,即 range 图像;

-

(B)2D 图像完全卷积语义分割;

-

(C)从原始点云中恢复所有点的从 2D 到 3D 的语义转换,无论使用的距离图像离散化如何;

-

(D)基于有效距离图像的 3D 后处理,对所有点使用基于 GPU 的快速 kNN 搜索,消除不需要的离散化和推理伪影

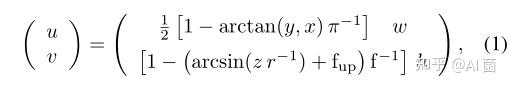

A、点云到 range 图像的转换,将点云一球坐标系表示,然后转换成Range图像,从3D到2D的转换过程如下公式:

range图像:距离图像,也叫深度图像,可以直接反应景物可见表面的几何形状。

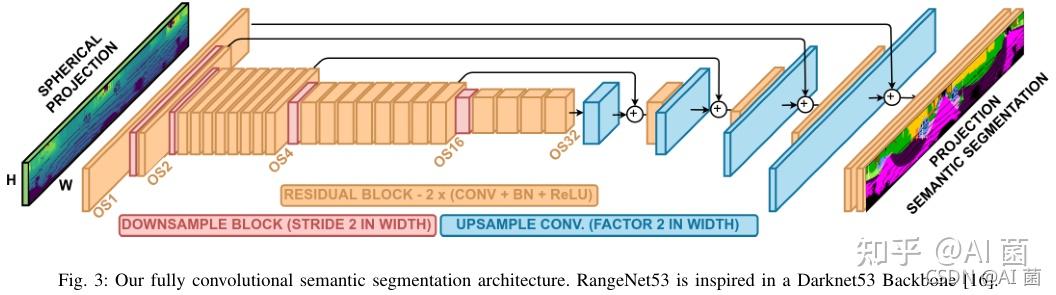

B、全卷积分割网络(FCN)

只对Range图像的W方向进行下采样,H方向维持不变

最后输出OS32(output stride ,图像缩小了32倍)

之后连接的是解码器模块( decoder module),将卷积提取的特征(feature code)上采样到原始图像分辨率,添加卷积层细化这些结果。同时,在每次上采样之后,我们还在编码器的不同级别的输出步幅(OS)之间添加跳跃连接,并将它们与解码器中相应的输出步幅特征体积相加(如图黑色箭头所示),以恢复一些在降采样过程中丢失的高频边缘信息。

解码之后最后一层是[1x1]的卷积,输出[n x h x w]logits的输出量,n是数据中类的数量。

最后一层softmax function 是:

logitc:类c的切片中的无界输出

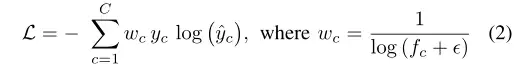

使用随机梯度下降和加权交叉熵损失进行端到端优化:

根据其频率fc的倒数来惩罚(penalize)c类

C、从range图像重建点云

为了推断语义云表示中的所有原始点,对初始渲染过程中获得的所有数据使用所有 (u, v) 对,并使用与每个点对应的图像坐标对距离图像进行索引。

D、点云后处理

本文提出了一种直接在输入点云中运行的快速、支持 GPU 的 k 最近邻 (kNN) 搜索。这使我们能够为语义点云中的每个点找到扫描中最接近 3D 的 k 个点的共识投票。由于在 kNN 搜索中很常见,我们还为搜索设置了一个阈值,我们称之为截止,设置被认为是近邻的点的最大允许距离。对 k 个最近点进行排序的距离度量可以是范围内的绝对差值,也可以是欧几里得距离。

实验评估

数据集:KITTI

超参数选择:学习率10^(-3),epoch:0.99,训练150个epoch

评价标准:

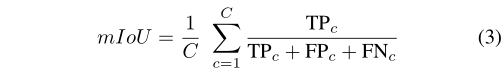

其中TPc、FPc、FNc分别对应类c预测的true positive、false positive、false negative,c为类数。

标签:++,距离,RangeNet,卷积,range,笔记,图像,点云,3D From: https://www.cnblogs.com/Ms-wang/p/17173577.html