2024深度学习发论文&模型涨点之—KAN+Transformer

KAN+Transformer是一种结合了Kolmogorov-Arnold Networks(KAN)和Transformer架构的新型神经网络模型。这种结合模型利用了KAN的灵活性和可解释性,以及Transformer的强大表示能力和序列处理能力,以提高复杂数据任务的效率和准确性。

在将KAN集成到Transformer中时,研究者面临三个关键挑战:基函数的选择、参数和计算效率低下、权重初始化问题。为了克服这些挑战,研究者提出了三个解决方案:使用有理函数替换B样条函数、通过一组神经元共享激活权重的Group KAN、以及Variance-preserving初始化。

更加赞的是,KAN作为一种新兴技术,还没有被广泛深入研究,因此为KAN与Transformer的结合提供了广阔的创新空间。这一领域中涌现的众多杰出成果为我们提供了丰富的参考,无疑,这是一个发表学术论文的绝佳领域。

小编整理了一些KAN+Transformer论文合集,以下放出部分,全部论文PDF版文末领取。

论文精选论文精选论文1:A Temporal Kolmogorov-Arnold Transformer for Time Series Forecasting

方法:

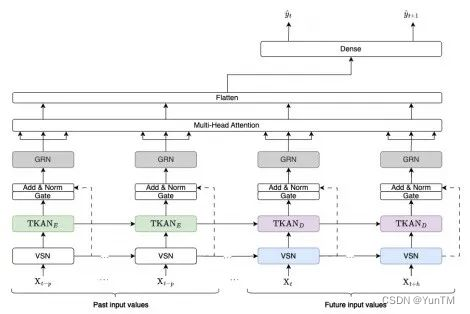

用于时间序列预测的时序Kolmogorov-Arnold变换器方法模型架构:提出了时序Kolmogorov-Arnold变换器(TKAT),一种基于注意力机制的新型架构,使用时序Kolmogorov-Arnold网络(TKANs)来处理多变量数据流中的复杂时间模式和关系。

数据集使用:专注于预测Binance交易所的交易量,使用的数据集包含从2020年1月1日到2022年12月31日的多个资产的小时交易额数据。

模型训练:采用均方根误差(RMSE)作为损失函数,优化模型以提高预测准确性,并使用Adam优化器进行训练。

性能评估:通过R-squared(R2)指标评估模型性能,并与多种基线模型进行比较。

创新点:

Kolmogorov-Arnold表示理论的应用:将Kolmogorov-Arnold表示理论的理论基础与变换器的强大能力相结合,以简化时间序列中的复杂依赖关系,并提高其“可解释性”。

长程依赖捕捉:利用变换器架构中的自注意力机制捕捉数据中的长程依赖,这对于提高预测准确性至关重要。

时序数据的编码器-解码器模型:TKAT作为一种编码器-解码器模型,特别适合于那些已知输入较少而观察输入较多的任务,如金融任务。

论文2:

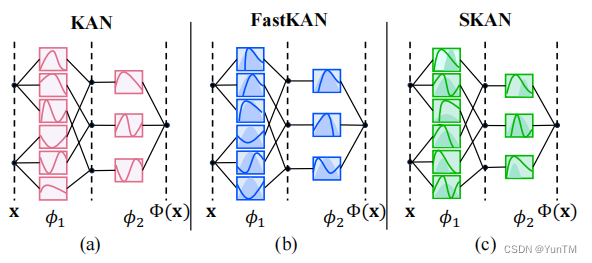

GNN-SKAN: Harnessing the Power of SwallowKAN to Advance Molecular Representation Learning with GNNs利用SwallowKAN的力量推进基于GNNs的分子表示学方法SwallowKAN(SKAN)的引入:提出了SKAN,它采用自适应RBFs作为核心,提高了计算效率,并增强了对多样分子结构的适应性。

方法:

GNN与KAN的集成:首次将KAN的卓越近似能力与GNNs在处理分子图方面的优势相结合,提出了GNN-SKAN和GNN-SKAN+。

性能与效率的平衡:GNN-SKAN和GNN-SKAN+在保持较低时间和内存需求的同时,实现了高准确性和鲁棒泛化,超越或匹配了SOTA模型。

创新点:

混合方法的提出:首次将时间序列分析和频域分析相结合,提出了一种新的混合检测方案,提高了检测的敏感性同时降低了误报率。

EWS算法的引入:提出了一种新的时域算法Epileptiform Wave Sequence (EWS)分析,专门针对具有中等不规则结构、突然相位变化或扭曲的癫痫发作模式。

实际应用的验证:在超过22000小时的未选择和未切割EEG记录和623次癫痫发作的数据库上测试了新方法,证明了其在临床设置中的有效性。

论文3:

Kolmogorov-Arnold Network Autoencoders

Kolmogorov-Arnold网络自动编码器

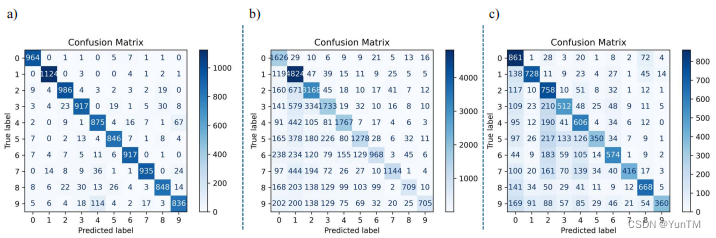

方法模型架构:探索了Kolmogorov-Arnold网络(KANs)在自动编码器中的数据表示效果,并与传统的卷积神经网络(CNNs)在MNIST、SVHN和CIFAR-10数据集上的性能进行了比较。

方法:

数据集使用:使用了MNIST、SVHN和CIFAR-10三个标准图像数据集进行实验。

模型训练:使用AdamW优化器进行训练,学习率为1e-3,权重衰减为1e-4,并使用均方误差(MSE)作为损失函数。

性能评估:基于重建误差和下游分类任务的准确性和F1分数来评估自动编码器的性能。

创新点:

KANs在自动编码器中的应用:首次将KANs应用于自动编码器框架中,以评估其在图像表示任务中的有效性。

理论基础的利用:KANs基于Kolmogorov-Arnold表示定理,通过在网络边缘放置激活函数

论文4:

TransUKAN: Computing-Efficient Hybrid KAN-Transformer for Enhanced Medical Image Segmentation

用于增强医学图像分割的计算效率高的混合KAN-Transformer

方法:

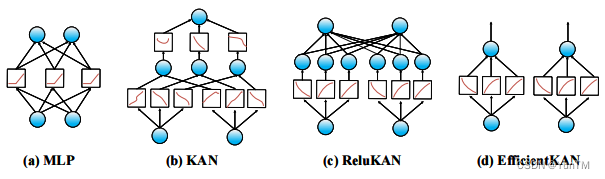

模型架构:提出了TransUKAN模型,该模型结合了U-Net、Transformer和Kolmogorov-Arnold Networks(KAN)的优势,通过引入改进的KAN来增强模型捕捉非线性关系的能力,同时补偿Transformer在局部信息提取上的不足。

数据集使用:在多个医学图像分割任务上验证了TransUKAN,包括ISIC皮肤病变图像、Kvasir息肉图像、BUSI乳腺超声图像和NKUT儿童下颌智齿分割数据集。

模型训练:使用Adam优化器进行模型训练,初始学习率设置为1e-4,并采用权重衰减以防止过拟合。训练周期设置为200,前10个周期为预热阶段,之后采用余弦退火学习率衰减。

性能评估:使用DICE、IOU和准确率作为评估指标,同时记录模型参数和推理时间,以全面评估模型性能。

创新点:

KAN的改进与应用:首次将KAN应用于医学图像分割领域,通过改进KAN减少内存使用和计算负载,提出EfficientKAN,通过在KAN的激活整合阶段稀疏化矩阵,简化计算过程,使其高效适用于医学图像处理任务。

参数和计算效率的提升:TransUKAN在保持与最先进的方法相当的性能的同时,显著减少了参数数量,展示了其在医学图像分割任务中的有效性和优越性。

模型性能和训练效率的平衡:通过平均池化操作仅整合当前神经元的激活值,避免了不必要的计算负担,同时保留了关键特征信息,提高了模型的计算效率和稳定性。

论文原文+开源代码需要的同学关注“AI科研论文”公号,那边回复“KAN+Transformer”获取。

标签:Transformer,论文,模型,Kolmogorov,transformer,Arnold,idea,KAN From: https://blog.csdn.net/YunTM/article/details/143338207