相信大部分了解LoRa的朋友们都知道,LoRa是低功耗广域网通信技术中的一种,是Se***ch公司专有的一种基于扩频技术的超远距离无线传输技术。 LoRaWAN是为LoRa远距离通信网络设计的一套通讯协议和系统架构。它是一种媒体访问控制(MAC)层协议。而我们今天的主角LoRa SIP模块动能世纪XD6500S集成RF前端+LoRa无线电收发器SX126*,它的电池寿命长,有功接收电流消耗4.2mA,最大发射功率可达+22dBm。该模块具有对-148 dBm的高灵敏度,为各种应用场景提供了较高的抗干扰性。采用LGA封装,尺寸非常小,仅为8x8x1.3毫米。

XD6500S的性能参数:

占用空间小:8x8x1.3毫米

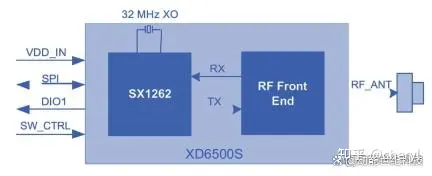

集成射频前端+LoRa无线电收发器SX1262系列

频率范围:

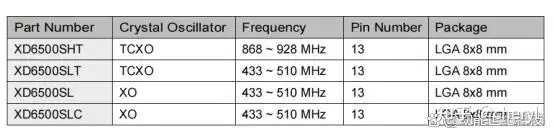

—433/470~510MHz(SL/SLT/SLC)

—868~928MHz(SHT)

嵌入式晶体类型:XO(SL/SLC)/TCXO(SLT/SHT)

最大功率:LoRa CW时高达22 dBm

LoRa高灵敏度:

— -148dBm,BW=10.4KHz,SF12(SL/SLT/SHT)

— -129dBm,BW=125KHz,SF9(SLC)

— -129dBm,BW=250KHz,SF10 (SLC)

最大链路预算:

—170dB,BW=10.4KHz时,SF12(SL/SLT/SHT)

—151dB,BW=125KHz时,SF9 (SLC)

可编程比特率LoRa:

—BW=500KHz时最大62.5 Kbps,SF5

—最小0.018Kbps,BW=7.8 KHz,SF12(SL/SLT/SHT)

—最小1.76Kbps,BW=125 KHz,SF9(SL/SLT/SHT)

可编程比特率GFSK,最高300 Kbps

前导码检测

135dB动态范围RSSI

卓越的抗阻塞性能

具有超快AFC的自动RF检测和CAD

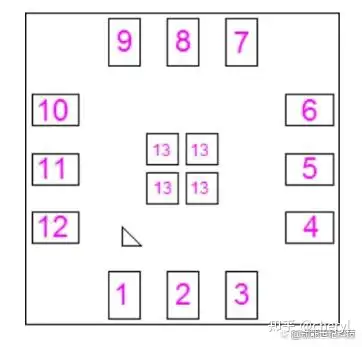

其模块框图+引脚图如下所示:

选型推荐:

XD6500S的应用场景推荐如下:

智能仪表

供应链和物流

楼宇自动化

农业传感器

智能城市

零售店传感器

资产跟踪

路灯

停车传感器

环境传感器

医疗保健

安全和安保传感器

远程控制应用

标签:SIP,SHT,XD6500S,SLT,BW,SL,LoRa From: https://www.cnblogs.com/guo13824368625/p/17956061