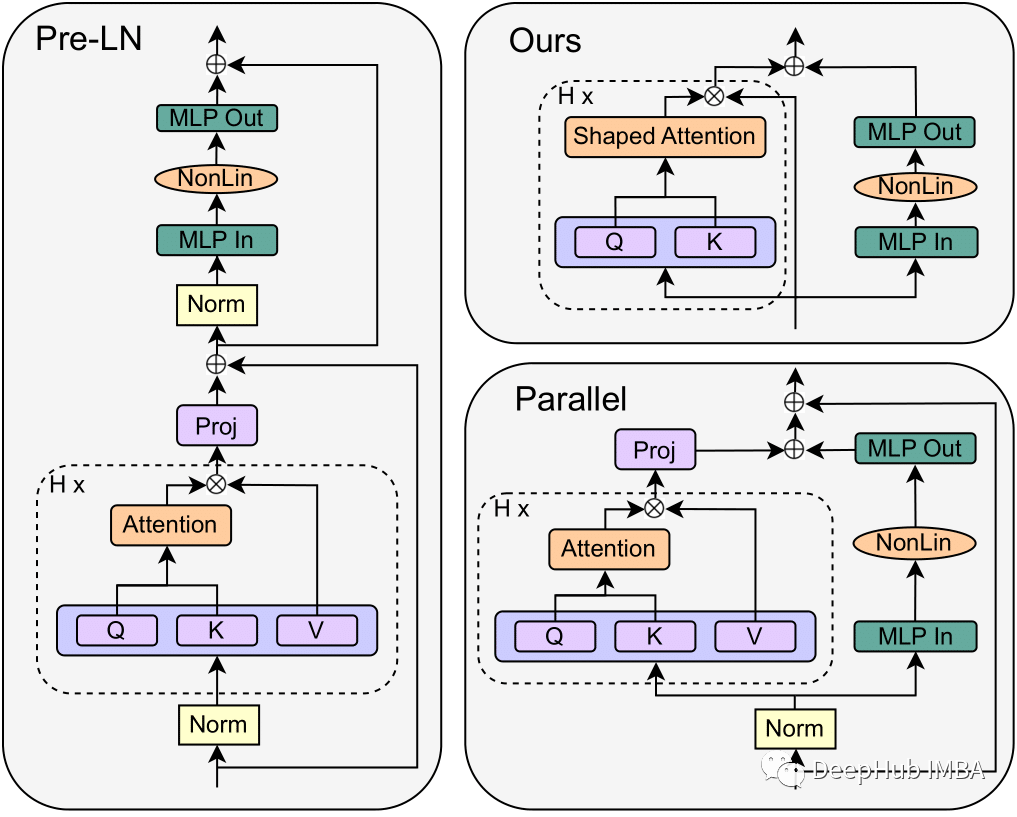

在这篇文章中我将深入探讨来自苏黎世联邦理工学院计算机科学系的Bobby He和Thomas Hofmann在他们的论文“Simplifying Transformer Blocks”中介绍的Transformer技术的进化步骤。这是自Transformer 开始以来,我看到的最好的改进。

大型语言模型(llm)可以通过各种扩展策略扩展其功能。更直接的方法包括放大计算资源——这是一个应用人工智能工程的问题,通常更容易获得。而另一种更微妙、更有效的方法涉及改进底层的数学框架。这种方法代表了人工智能研究的前沿,是一项很少有人能熟练驾驭的努力。

https://avoid.overfit.cn/post/55636b1affd6459fa0f5c1de0d512d4e

标签:Transformer,简化版,论文,详解,Simplifying,Block From: https://www.cnblogs.com/deephub/p/17869357.html