本文分享自华为云社区《基于卷积神经网络的MAE自监督方法》,作者: Hint 。

图像自监督预训练算法是近年来的重要研究方向,MAE是其中基于ViT实现的代表性方法,学习到了鲁棒的视觉特征。MAE全称是Masked Autoencoders,是由何凯明提出的自监督预训练方法,借鉴了BERT的预训练任务,将输入图片的patch以较大的比例进行mask,并通过非对称的ViT编码解码器结构,进行masked patches的重建任务。该方法在性能上超过了以往的对比学习方法,如MoCo系列等。然而ViT的结构复杂,计算量庞大,基于CNN的类MAE方法具有极高研究价值,但受限于CNN的结构特性,常规的MAE方式无法直接在CNN上应用。本文介绍ICLR2023的方法Spark[1],实现了基于CNN的MAE。

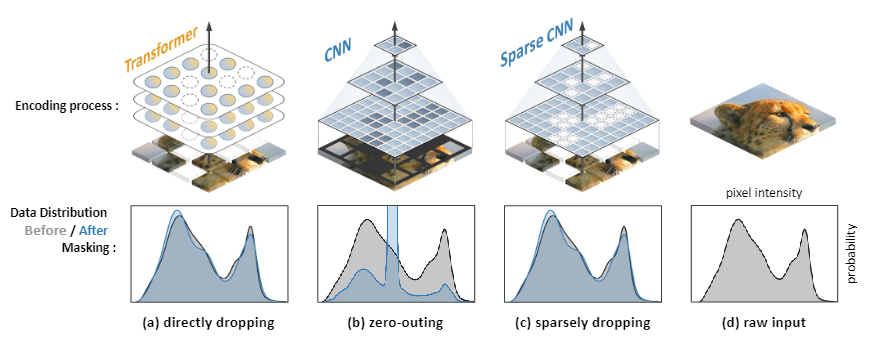

如上图所示,对于一个masked的输入图片,对ViT输入和CNN的输入计算统计直方图,ViT的直方图是和未mask的图片分布一致的,而CNN的直方图发生了很大变化。这是由于ViT结构天然适合处理变长、不规则的输入,且不同的输入之间不会重叠计算。CNN的滑窗操作和规则的卷积核形状,导致模型会严重受到mask部分的影响。

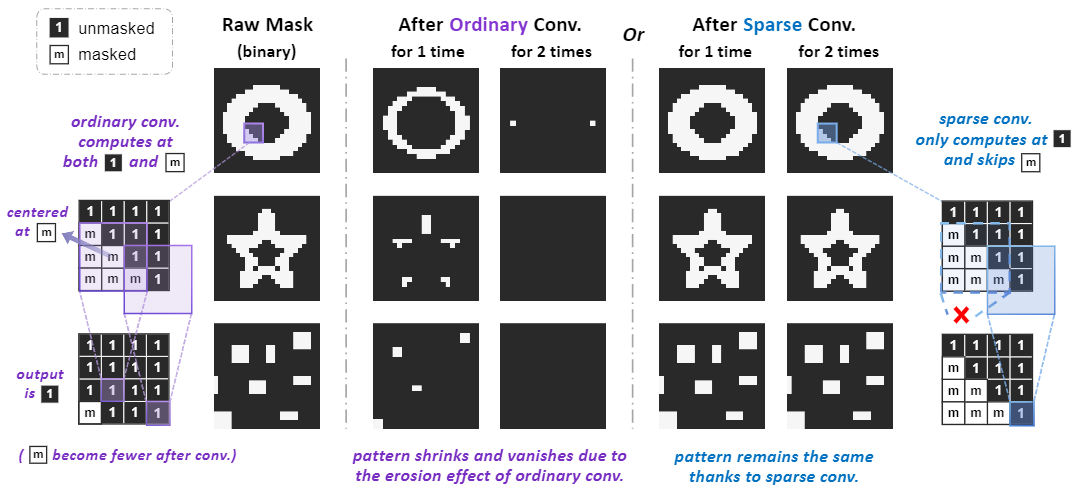

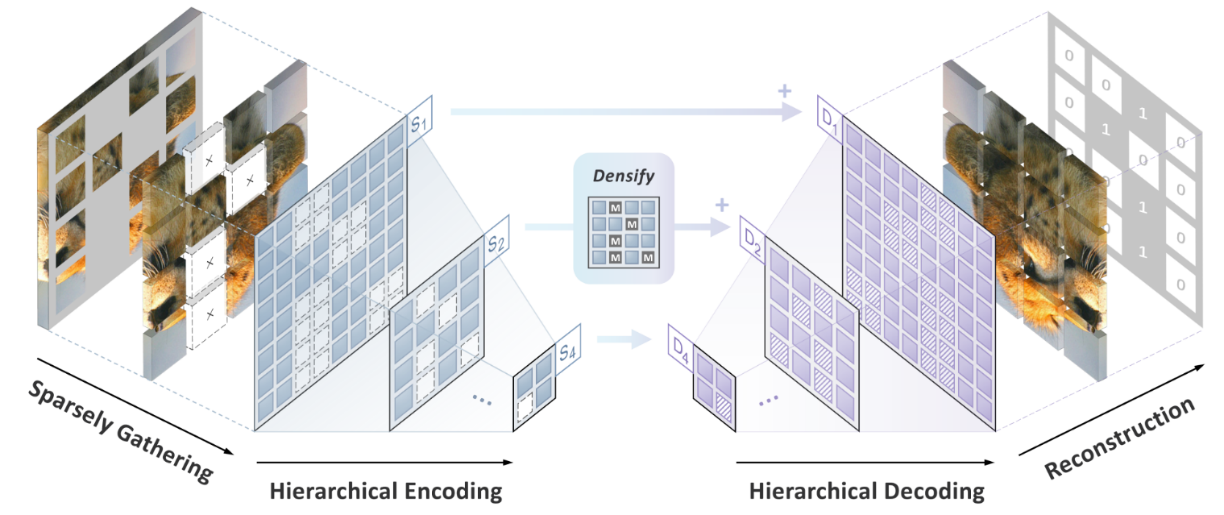

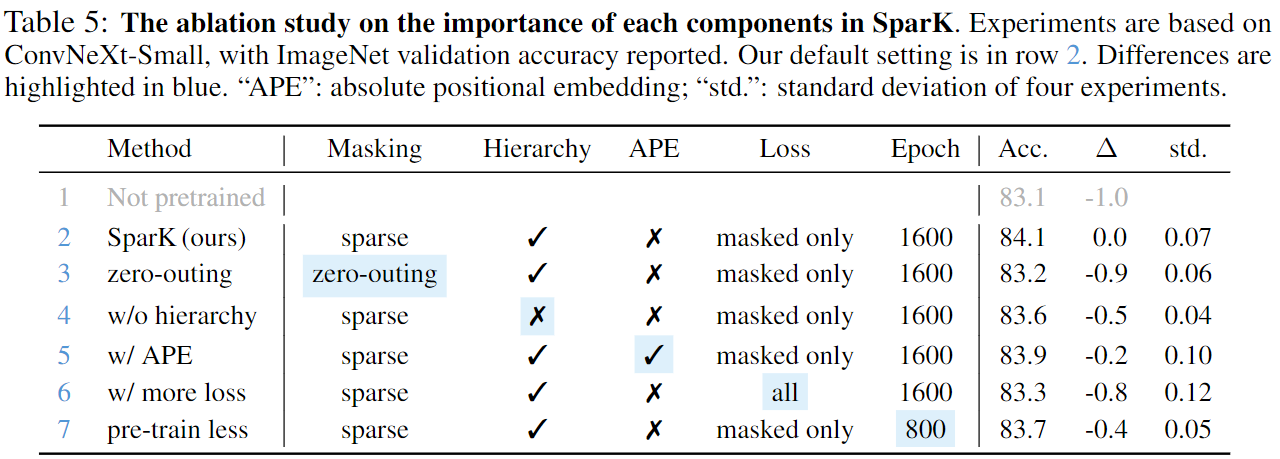

因此作者借鉴了3D点云领域的稀疏卷积,该卷积只对未mask的像素进行计算,忽略masked的像素,可以处理不规则的输入,实现了和ViT类似的效果。另外,为了学习到多尺度的特征,作者设计了分层次的解码器,参考了UNet的结构设计,使模型学习到多尺度的特征,适应CNN的多层级结构。

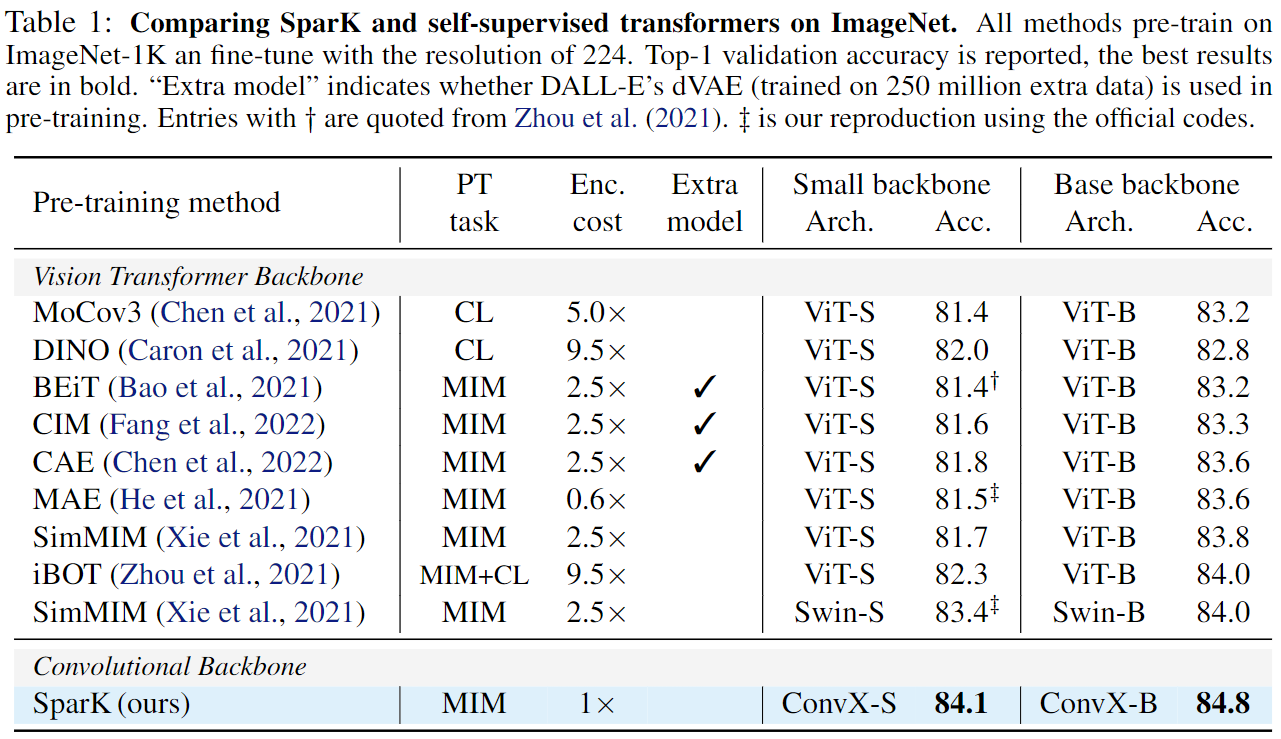

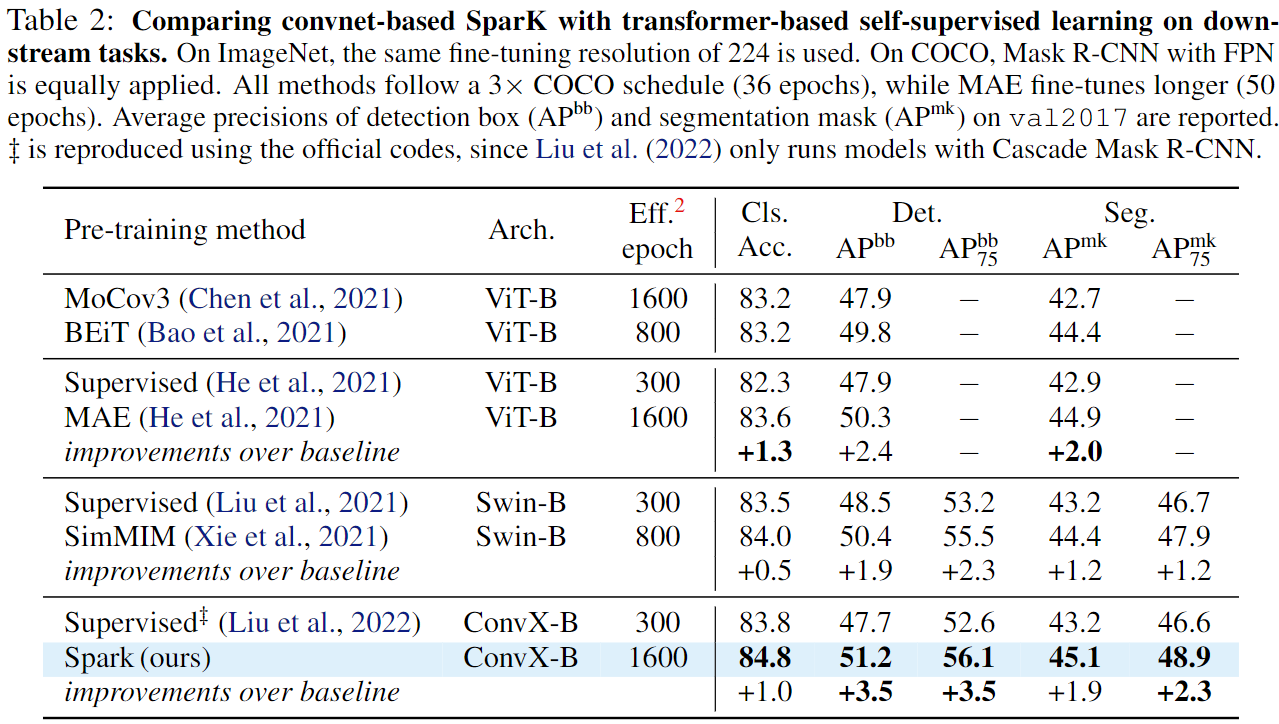

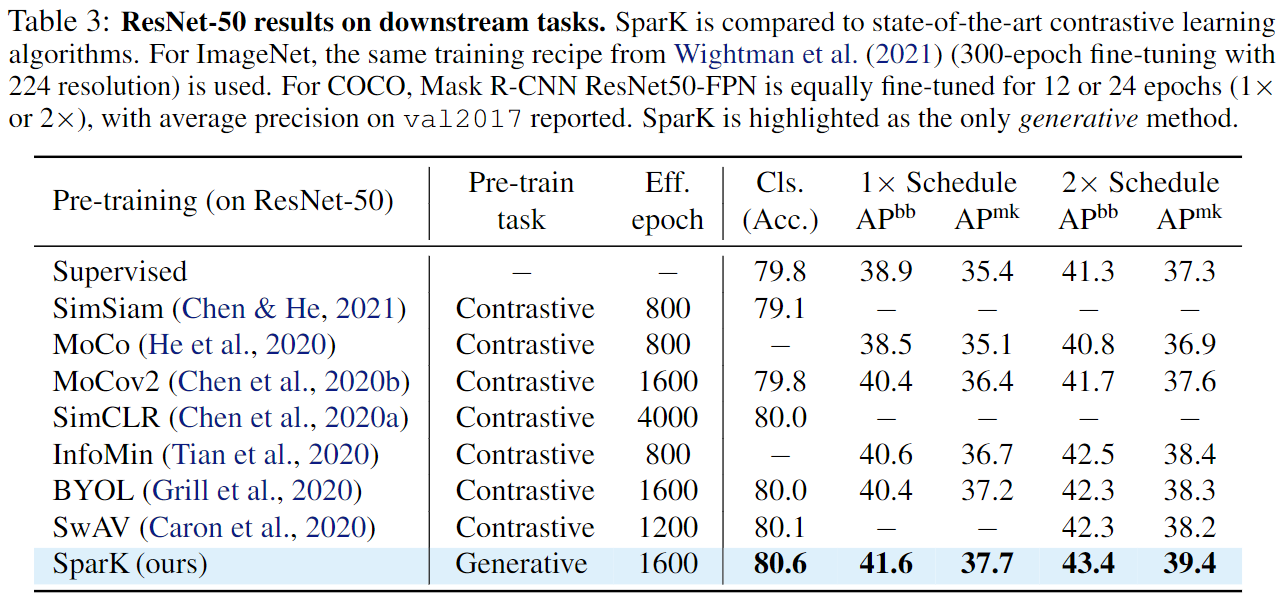

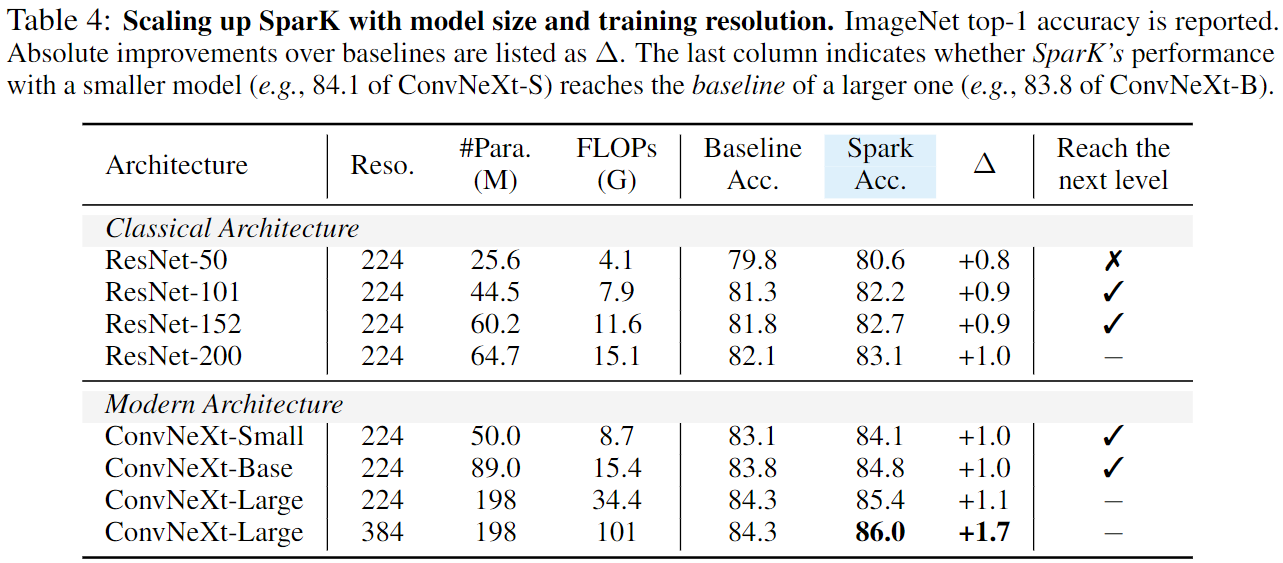

从以下的实验结果来看,该方法的性能媲美原始的MAE方法,并在各种下游任务中取得了SOTA的结果,作者也证明了各个设计模块的有效性以及该方法的通用性。

[1]Tian K, Jiang Y, Diao Q, et al. Designing BERT for Convolutional Networks: Sparse and Hierarchical Masked Modeling[J]. arXiv preprint arXiv:2301.03580, 2023.

标签:卷积,神经网络,MAE,ViT,CNN,方法,输入 From: https://www.cnblogs.com/huaweiyun/p/17623137.html