本文将将介绍注意力的概念从何而来,它是如何工作的以及它的简单的实现。

注意力机制

在整个注意力过程中,模型会学习了三个权重:查询、键和值。查询、键和值的思想来源于信息检索系统。所以我们先理解数据库查询的思想。

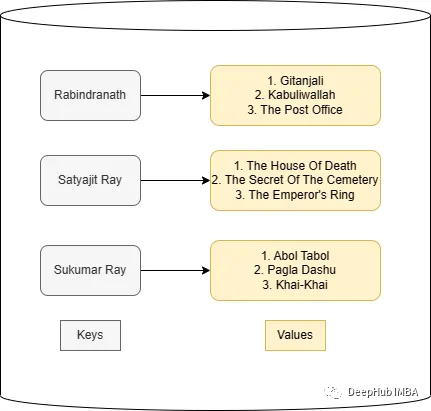

假设有一个数据库,里面有所有一些作家和他们的书籍信息。现在我想读一些Rabindranath写的书:

在数据库中,作者名字类似于键,图书类似于值。查询的关键词Rabindranath是这个问题的键。所以需要计算查询和数据库的键(数据库中的所有作者)之间的相似度,然后返回最相似作者的值(书籍)。

https://avoid.overfit.cn/post/c3f0da0fd4bd4151a8f79741ebc09937

标签:transformer,数据库,键和值,查询,Rabindranath,图解,注意力 From: https://www.cnblogs.com/deephub/p/17492819.html