聚水潭数据集成到MySQL的技术案例分享

在企业数据管理中,如何高效、准确地将业务系统的数据集成到分析平台是一个关键问题。本篇文章将聚焦于一个具体的系统对接集成案例:将聚水潭的采购入库单数据集成到MySQL数据库中,以便在BI勤威平台上进行进一步的数据分析和处理。

案例背景

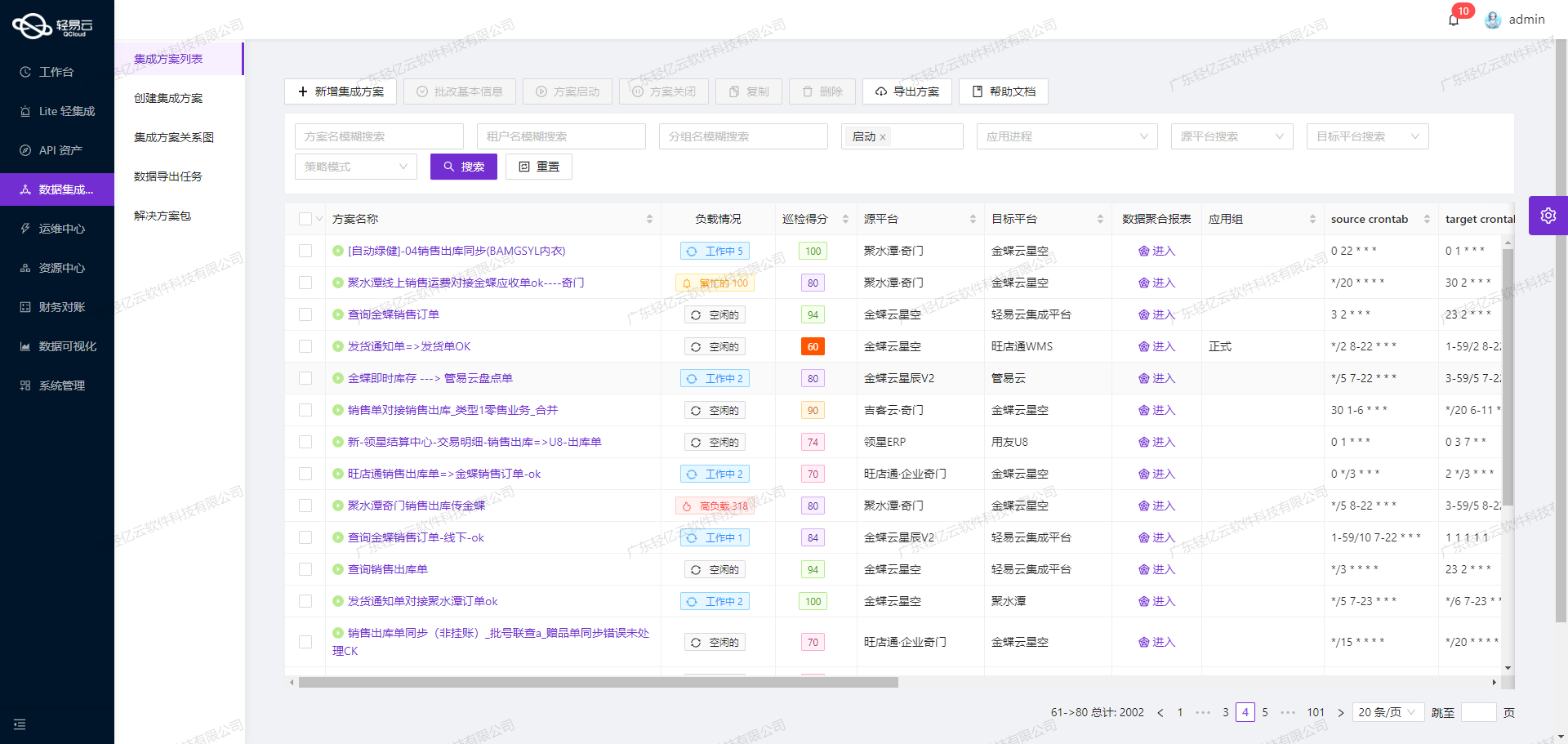

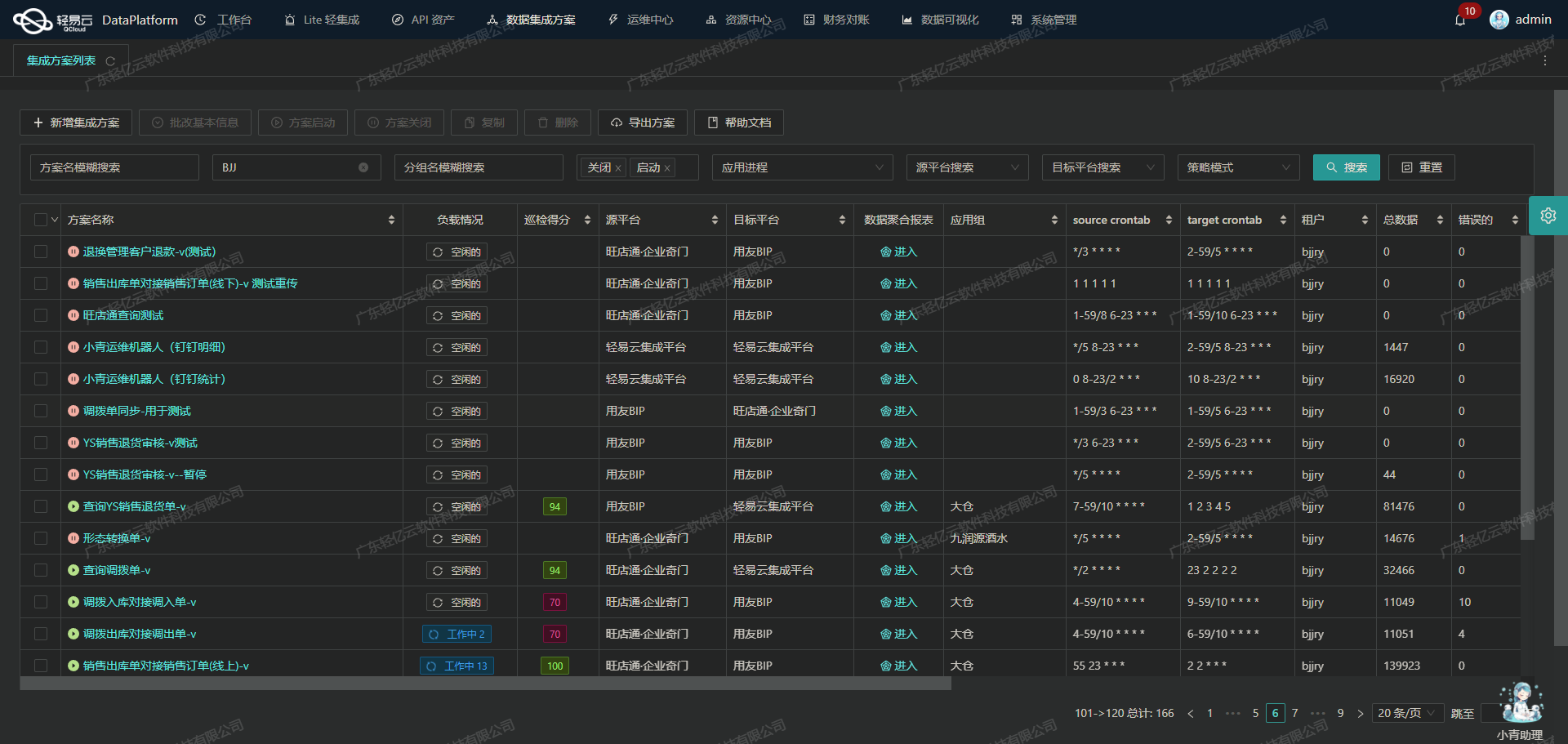

本次集成方案命名为“聚水潭-采购入库单-->BI勤威-采购入库表”,旨在实现从聚水潭获取采购入库单数据,并将其批量写入到MySQL数据库中的过程。通过这一方案,我们不仅能够确保数据的高效传输,还能实时监控整个数据流动和处理状态,提升业务透明度和效率。

技术要点

-

高吞吐量的数据写入能力:

为了应对大量采购入库单数据的快速写入需求,我们采用了支持高吞吐量的数据写入机制。这使得大量数据能够迅速被集成到MySQL系统中,大大提升了数据处理的时效性。 -

定时可靠的数据抓取:

通过定时任务,我们可以可靠地从聚水潭接口(/open/purchasein/query)抓取最新的采购入库单数据,确保不会漏单。同时,针对接口分页和限流问题,我们设计了相应的解决方案,以保证每次抓取操作都能顺利完成。 -

自定义数据转换逻辑:

在实际操作过程中,不同系统之间的数据格式往往存在差异。为了适应特定业务需求和数据结构,我们支持自定义的数据转换逻辑,使得从聚水潭获取的数据能够准确映射到MySQL目标表中。 -

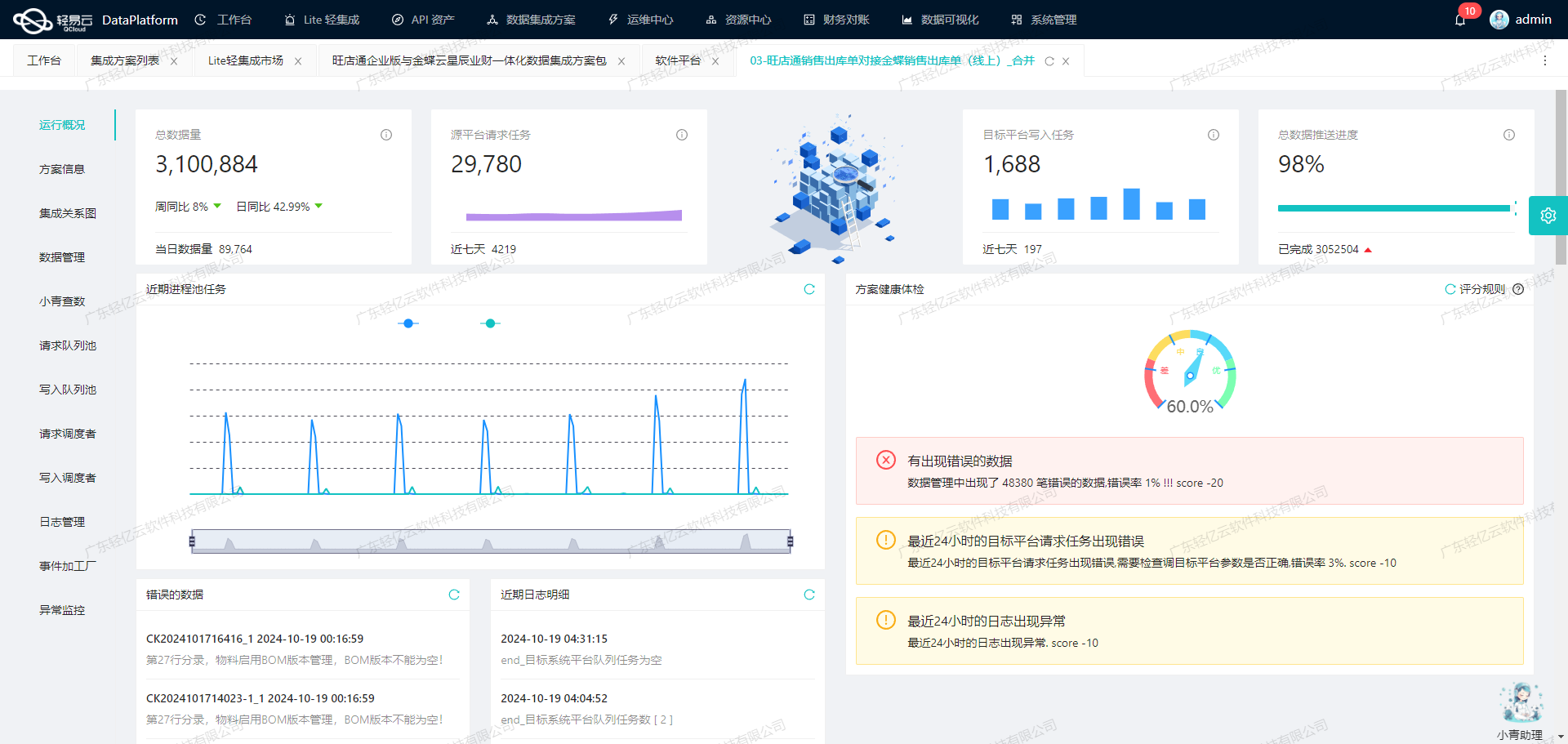

集中监控与告警系统:

集中的监控和告警系统实时跟踪每个数据集成任务的状态和性能。一旦出现异常情况,例如网络故障或接口调用失败,系统会立即发出告警通知,并启动错误重试机制,确保任务最终成功完成。 -

实时监控与日志记录:

整个集成过程中的每一步操作都会被详细记录下来,包括接口调用、数据转换、写入操作等。通过实时监控与日志记录功能,我们可以随时查看并分析每个环节的执行情况,从而及时发现并解决潜在问题。

数据质量监控与异常检测

为了保证最终进入MySQL数据库中的数据质量,我们引入了严格的数据质量监控与异常检测机制。在每次批量写入之前,对抓取到的数据进行全面校验,一旦发现异常立即进行处理。这不仅提高了整体流程的可靠性,也为后续BI分析提供了坚实基础。

以上是本次技术案例分享的开头部分,在接下来的章节中我们将详细介绍具体实施步骤及注意事项。

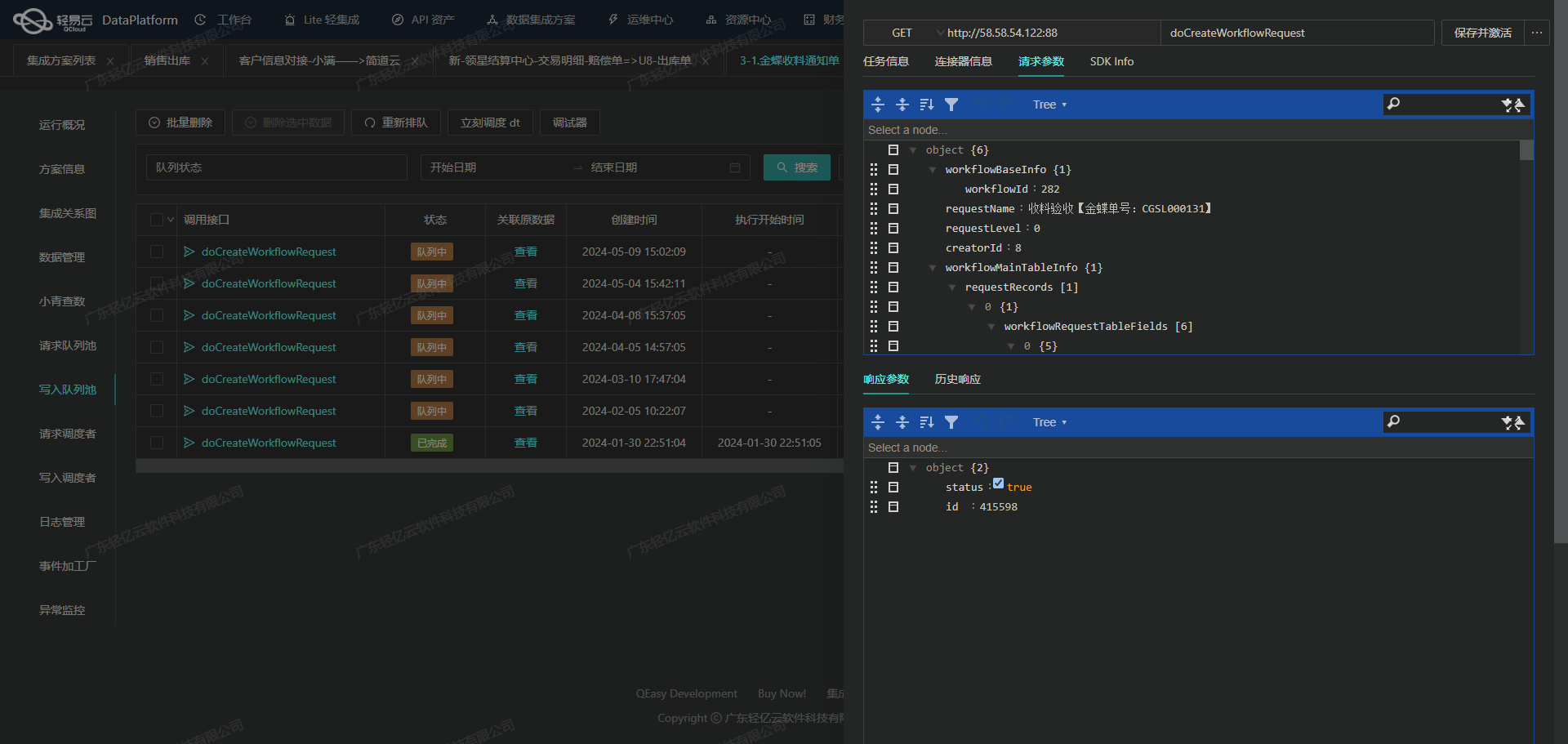

调用聚水潭接口/open/purchasein/query获取并加工数据

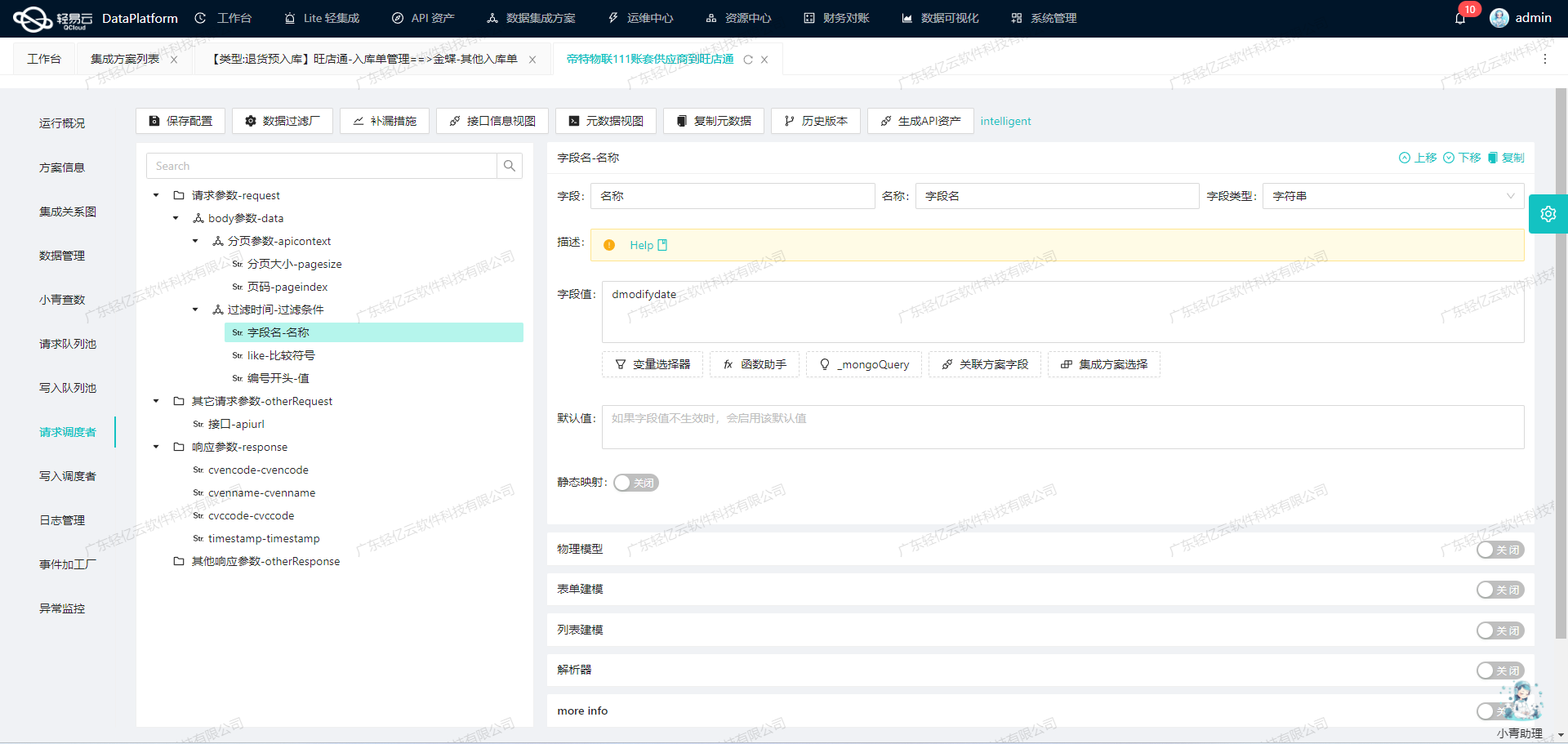

在数据集成的生命周期中,调用源系统接口是至关重要的一步。本文将详细探讨如何通过轻易云数据集成平台调用聚水潭接口/open/purchasein/query,并对获取的数据进行加工处理。

聚水潭接口配置与调用

首先,我们需要配置聚水潭的API接口。根据提供的元数据配置,API路径为/open/purchasein/query,请求方法为POST。以下是关键参数:

page_index: 第几页,从1开始。page_size: 每页数量,最大不超过50。modified_begin: 修改起始时间。modified_end: 修改结束时间。po_ids: 采购单号列表。io_ids: 采购入库单号列表。so_ids: 线上单号。

这些参数确保了我们可以灵活地分页获取数据,并根据修改时间或特定单号进行筛选。

数据请求与清洗

在实际操作中,我们通常会设置一个定时任务来定期抓取聚水潭的数据。例如,每小时抓取一次最近一小时内修改过的采购入库单信息。这就需要我们动态生成modified_begin和modified_end参数值:

{

"page_index": 1,

"page_size": 30,

"modified_begin": "{{LAST_SYNC_TIME|datetime}}",

"modified_end": "{{CURRENT_TIME|datetime}}"

}

为了确保数据完整性和避免漏单,可以使用分页机制逐页抓取。当返回的数据量达到每页最大值(如30条)时,应继续请求下一页的数据,直到没有更多数据为止。

数据转换与写入

获取到原始数据后,需要对其进行清洗和转换,以适应目标系统(如BI勤威)的需求。轻易云平台支持自定义数据转换逻辑,可以通过脚本或可视化工具实现。例如,将聚水潭返回的JSON结构平铺展开,以便于后续处理:

{

"items": [

{

"io_id": "12345",

"po_id": "67890",

...

}

]

}

在这个过程中,还需注意处理字段类型和格式差异。例如,将日期字符串转换为目标系统所需的日期格式,或者将数值字段从字符串类型转换为数值类型。

高效写入MySQL

为了提升写入效率,可以采用批量插入的方式,将处理后的数据一次性写入MySQL数据库。同时,为了保证事务一致性和错误重试机制,可以利用轻易云平台提供的异常处理功能。在发生网络故障或数据库连接问题时,可自动重试未成功的操作。

实时监控与日志记录

整个集成过程需要实时监控,以便及时发现并解决问题。轻易云平台提供了集中监控和告警系统,可以实时跟踪每个任务的状态和性能。此外,通过日志记录功能,可以详细记录每次API调用、数据处理及写入操作,为后续排查问题提供依据。

总结

通过上述步骤,我们可以高效地调用聚水潭接口获取采购入库单信息,并经过清洗、转换后批量写入MySQL数据库。在此过程中,充分利用轻易云平台提供的高吞吐量、实时监控、自定义转换等特性,实现稳定可靠的数据集成。

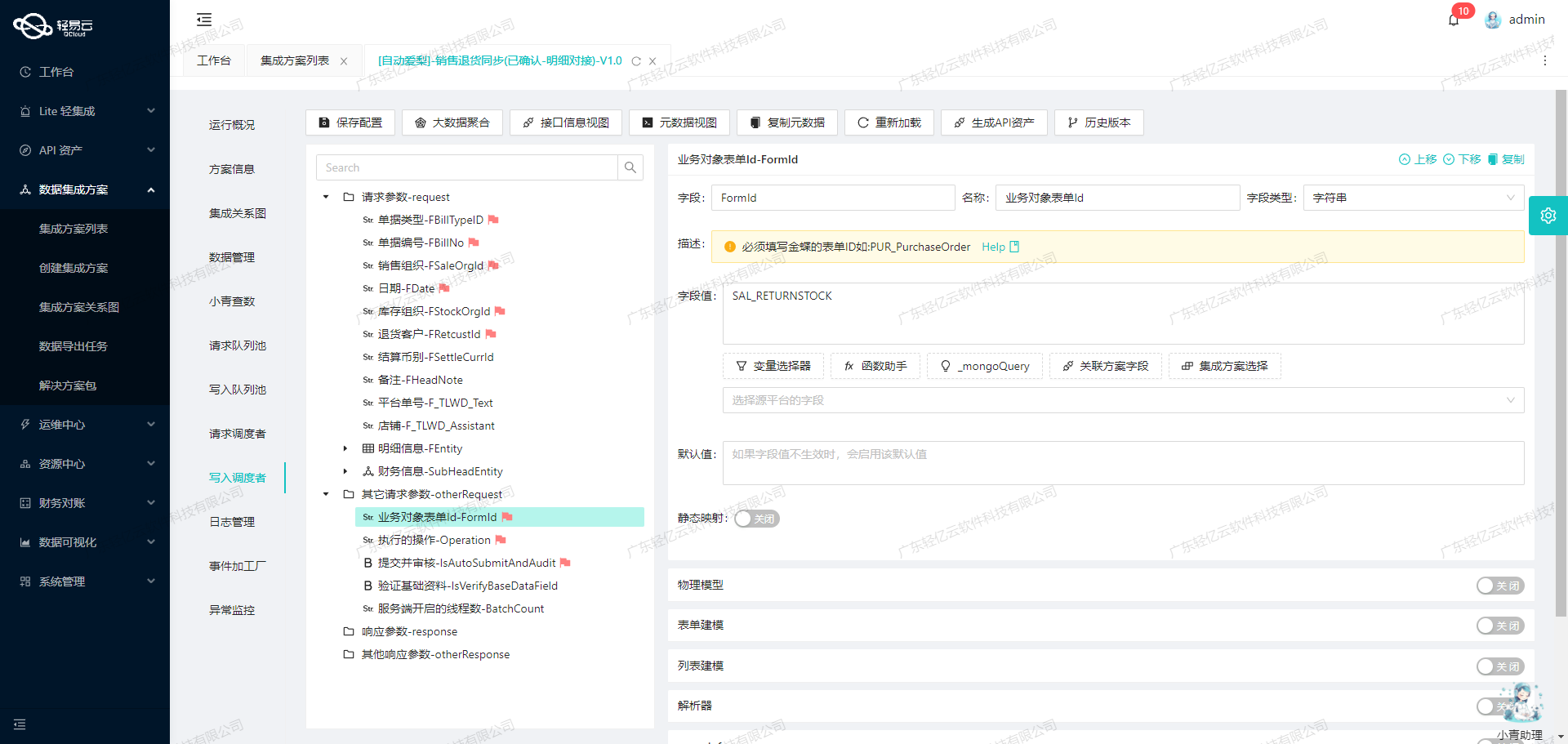

使用轻易云数据集成平台进行ETL转换并写入MySQLAPI接口

在数据集成的生命周期中,第二步涉及将已经从源平台获取的数据进行ETL(提取、转换、加载)处理,以适应目标平台MySQLAPI接口的格式要求,并最终写入目标数据库。这一步骤至关重要,因为它确保了数据的正确性和一致性。

数据提取与清洗

首先,从聚水潭系统提取采购入库单数据。通过调用聚水潭的/open/purchasein/query接口,可以获取到所需的数据。这一步需要特别注意接口的分页和限流问题,以确保数据提取的完整性和效率。

数据转换

在轻易云数据集成平台上,使用元数据配置来定义源数据与目标数据之间的映射关系。以下是一些关键字段及其转换逻辑:

- 主键id:通过组合

io_id和items_ioi_id生成唯一主键。 - 仓库名称warehouse:直接映射。

- 采购单号po_id:直接映射。

- 供应商编号supplier_id:直接映射。

- 状态status:需要根据业务规则进行转换,如将“WaitConfirm”转换为“待入库”。

元数据配置示例如下:

{

"field": "id",

"label": "主键",

"type": "string",

"value": "{io_id}-{items_ioi_id}"

}

这个配置说明了如何生成目标数据库中的主键字段。类似地,其他字段也需要根据业务需求进行相应的转换。

数据写入

在完成数据转换后,下一步是将其写入MySQL数据库。轻易云提供了高效的数据写入能力,可以处理大规模的数据集成任务。以下是一个SQL语句示例,用于将转换后的数据批量插入到MySQL中:

REPLACE INTO purchasein_query(

id, io_id, ts, warehouse, po_id, supplier_id, supplier_name, modified,

so_id, out_io_id, status, io_date, wh_id, wms_co_id, remark,

tax_rate, labels, archived, merge_so_id, type, creator_name,

f_status, l_id, items_ioi_id, items_sku_id, items_i_id,

items_unit, items_name, items_qty, items_io_id,

items_cost_price, items_cost_amount,

items_remark, items_batch_no,

items_tax_rate,sns_sku_id,sns_sn

) VALUES (?, ?, ?, ?, ?, ?, ?, ?, ?, ?, ?, ?, ?, ?, ?, ?, ?, ?, ?, ?,

?, ?, ?, ?, ?, ?, ?, ? ,?, ? ,?, ? ,?, ? ,?, ?)

通过这种方式,可以确保所有必要字段都被正确映射和写入到目标数据库中。

实时监控与异常处理

轻易云平台提供了集中监控和告警系统,可以实时跟踪数据集成任务的状态和性能。例如,当某个批次的数据写入失败时,系统会自动触发告警,并记录详细的日志信息,便于后续分析和处理。此外,还支持错误重试机制,以提高系统的可靠性。

数据质量监控

为了确保数据质量,轻易云平台还提供了多种数据质量监控和异常检测功能。例如,可以设置特定的规则来检查字段值是否符合预期范围,一旦发现异常情况,系统会自动记录并通知相关人员进行处理。

通过上述步骤,我们可以高效地将从聚水潭系统获取的数据经过ETL处理后,准确无误地写入到MySQL数据库中。这不仅提升了数据处理的时效性,也确保了业务决策所需的数据准确性和一致性。