我们在用python做爬虫的时候,除了直接用requests的架构,还有Scrapy、Selenium等方式可以使用,那么今天我们就来聊一聊使用Selenium如何实现爬虫。

Selenium是什么?

Selenium是一个浏览器自动化测试框架,是一款用于Web应用程序测试的工具。框架底层使用JavaScript模拟真实用户对浏览器进行操作。测试脚本执行时,浏览器自动按照脚本代码做出点击,输入,打开,验证等操作,就像真实用户所做的一样,从终端用户的角度测试应用程序。使浏览器兼容性测试自动化成为可能,尽管在不同的浏览器上依然有细微的差别。使用简单,可使用Java,Python等多种语言编写用例脚本。(百度百科)

如何使用Selenium?

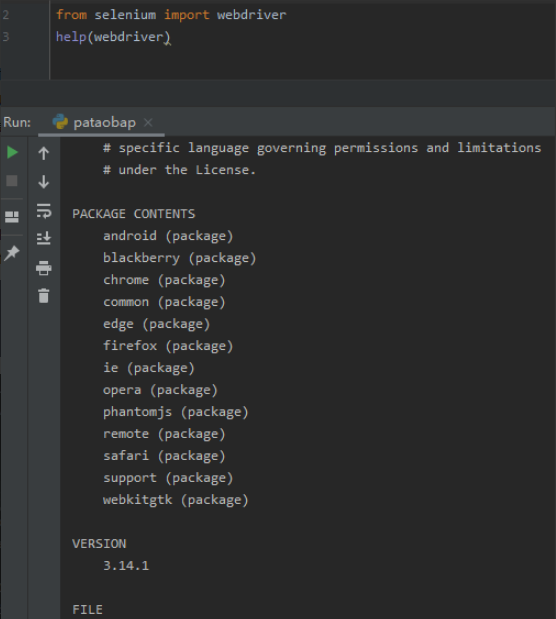

首先下载Selenium这个库,pip install selenium。接着查看Selenium支持的浏览器,这里就使用都会有的chrome谷歌浏览器,如果想要查看能用什么浏览器可以使用下面这些代码,就可以看到支持的浏览器和版本:

from selenium import webdriver help(webdriver)

然后再对应着浏览器的版本找相应的浏览器驱动。

驱动的位置一定要放在没有中文字符的文件夹中,好这个地址,有用。

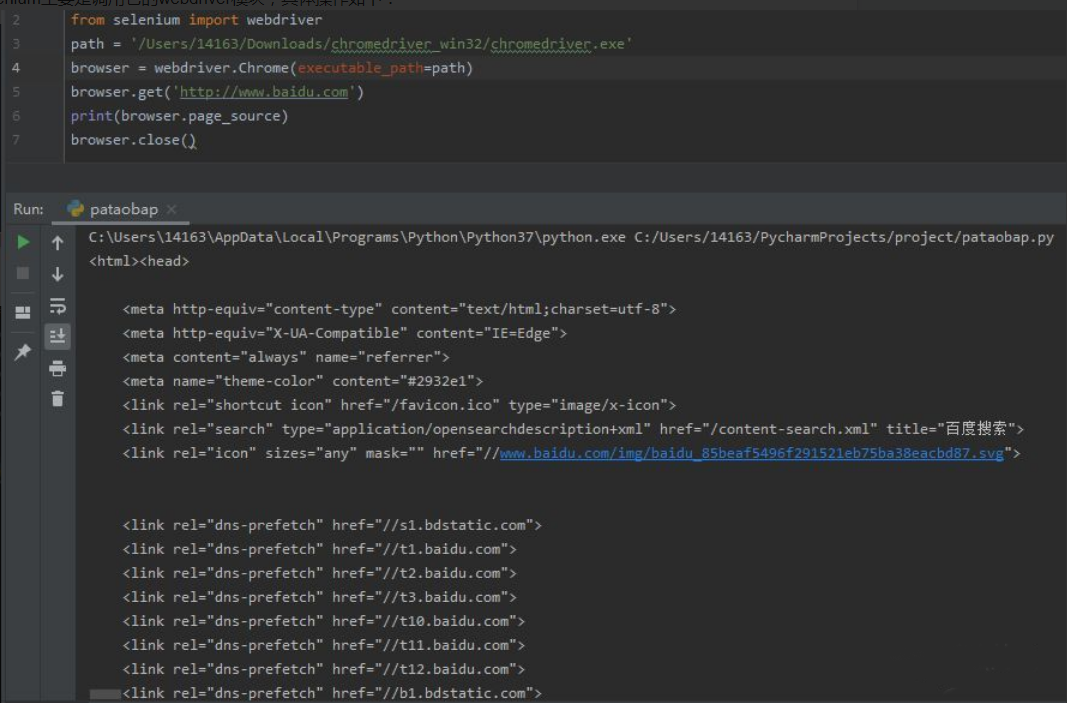

使用Selenium主要是调用它的webdriver模块,具体操作如下:

from selenium import webdriver

path = '/Users/14163/Downloads/chromedriver_win32/chromedriver.exe'#这里是保存的驱动的位置

browser = webdriver.Chrome(executable_path=path) #初始化驱动对象

browser.get('http://www.baidu.com') #获取url

print(browser.page_source) #输出获取到的文件数据

browser.close() #关闭浏览器

结果:

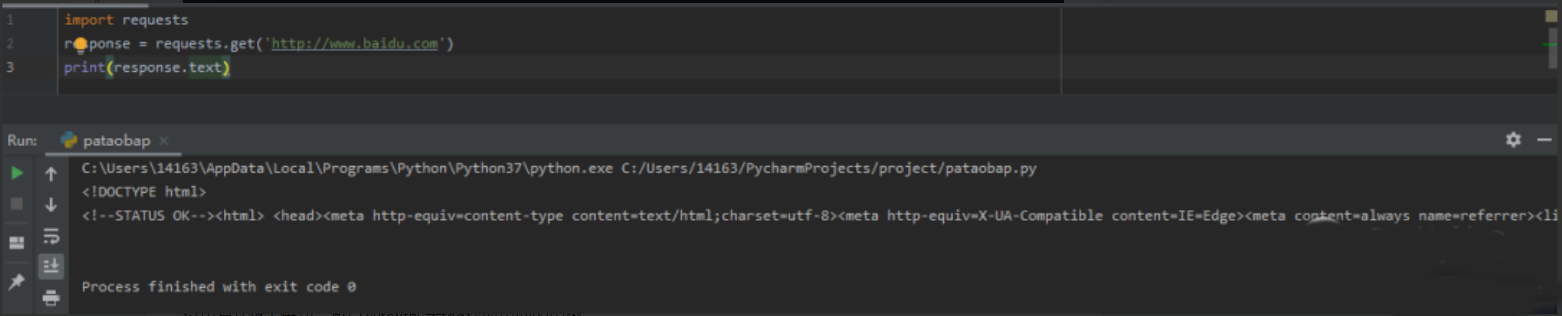

再对比一下requests获取的网页的数据:

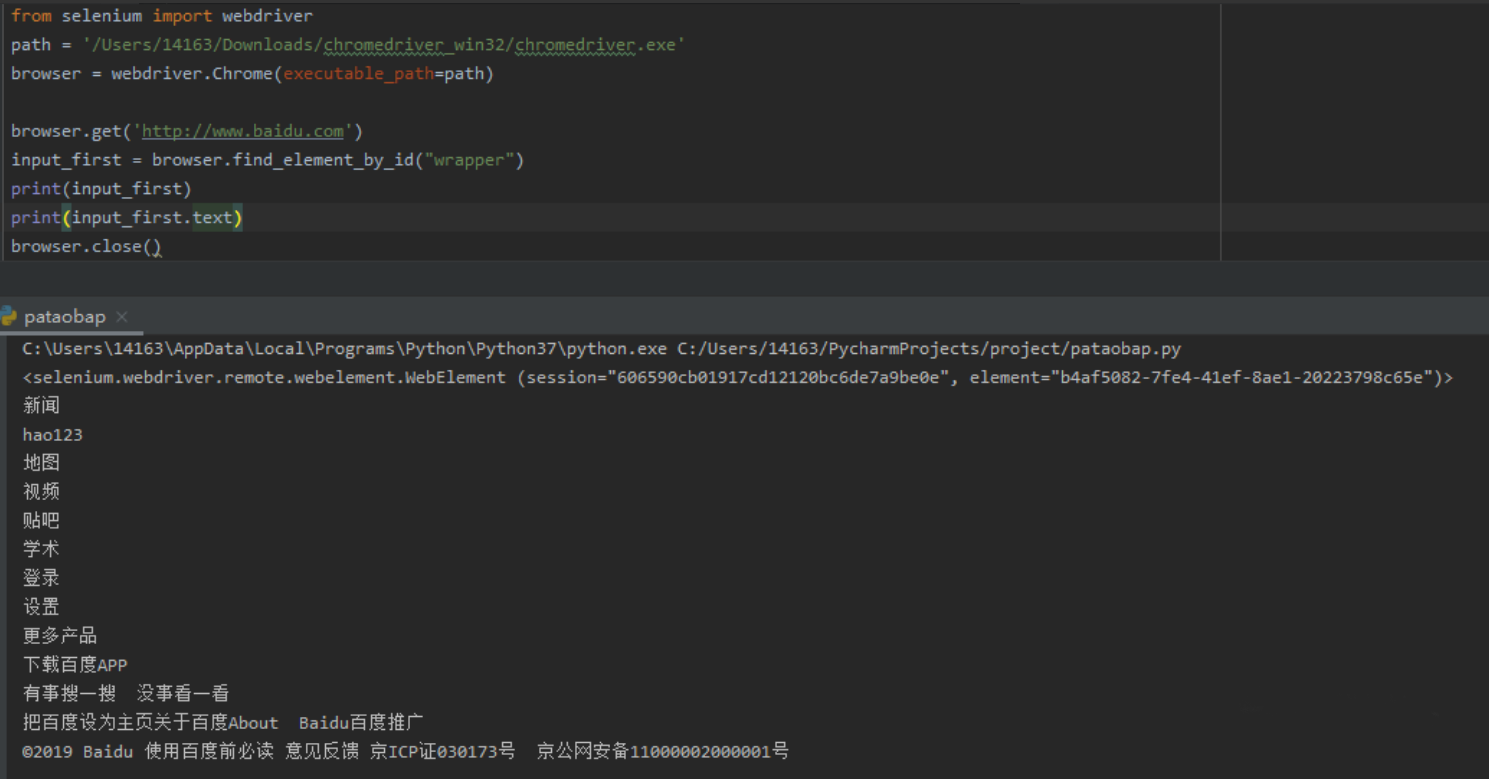

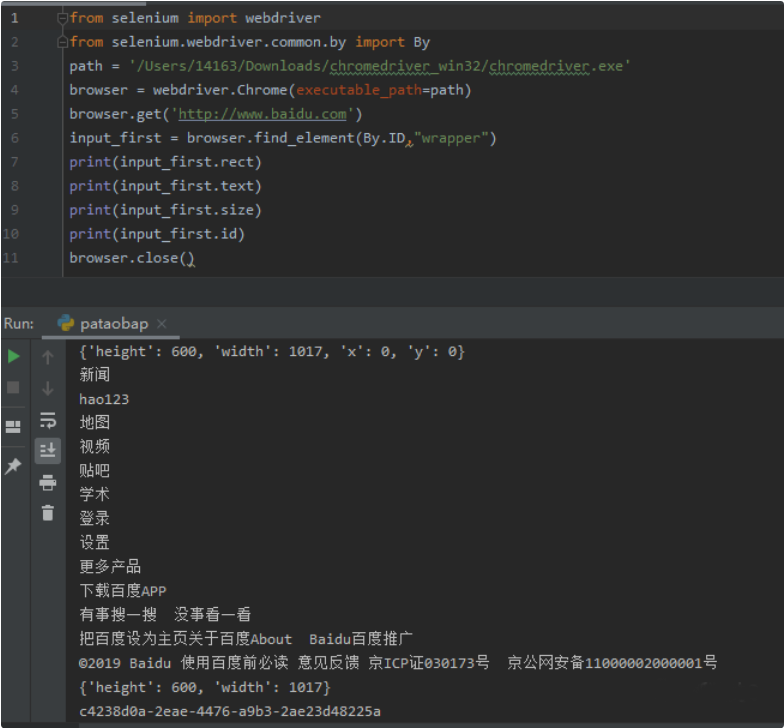

很明显selenium能获取得到的内容更多selenium有相应的函数去查找数据,单个元素的三种不同的方式去获取响应的元素,第一种是通过id的方式,第二个中是CSS选择器,第三种是xpath选择器,结果都是相同的。

这里是按id去查找,可以加text或者tag获取里面的内容。

或者可以调用另一个库去获取id,By

先 导入库:

from selenium.webdriver.common.by import By

这样就可以获取网页的数据。

这些只是获取一个元素的,可以获取多个元素加用find_elements即可。

交互操作:

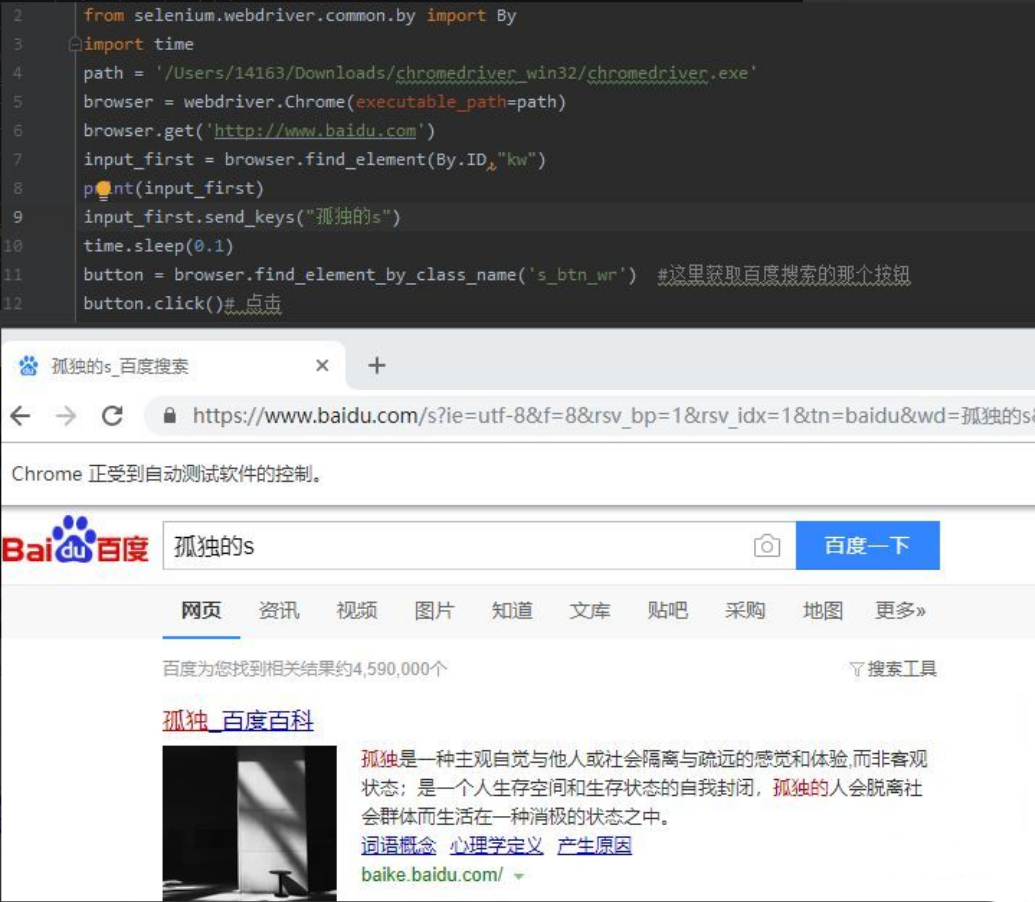

对网页进行操作,比如在百度的搜索框输入孤独的s,然后点击搜索就可以这样:

按以下代码:

from selenium import webdriver

from selenium.webdriver.common.by import By

import time

path = '/Users/14163/Downloads/chromedriver_win32/chromedriver.exe'

browser = webdriver.Chrome(executable_path=path)

browser.get('http://www.baidu.com')

input_first = browser.find_element(By.ID,"kw")

print(input_first)

input_first.send_keys("孤独")

time.sleep(0.1)

button = browser.find_element_by_class_name('s_btn_wr') #这里获取百度搜索的那个按钮

button.click()# 点击

结果:

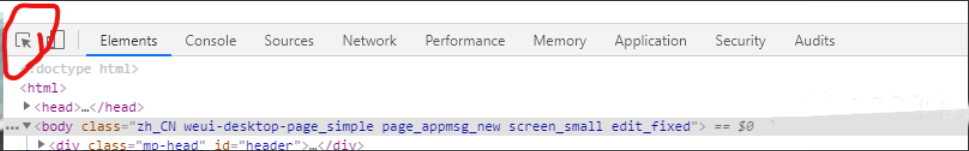

在chrome中想要找到对应的按钮的元素或者id,可以点击红圈这个,然后再去移动去原网页,就可以知道结果:

不得不说,selenium真便利。

标签:webdriver,浏览器,Python,selenium,Selenium,爬虫,获取,browser From: https://www.cnblogs.com/q-q56731526/p/17174747.html