近年来,随着人工智能技术的飞速发展,各种模型和平台应运而生,以满足从个人用户到企业级应用的多样化需求。在这一领域,GPT-Omni 和 Mini-Omni2 是两款备受瞩目的技术产品,它们凭借独特的设计和强大的功能,在人工智能应用领域中占据了一席之地。本文将简要介绍它们的特点和适用场景。

GPT-Omni:全能型智能模型

GPT-Omni 是一款综合性语言模型,旨在提供强大的自然语言处理(NLP)能力。它以 GPT 技术为核心,具有以下主要特点:

多领域适用性

GPT-Omni 被设计为“全能型”模型,无论是文本生成、语义理解、还是问答系统,它都能提供出色的表现。其多领域的适应能力使其成为企业开发复杂应用的理想选择。

高效的学习与推理能力

模型经过大量高质量数据的训练,能快速学习新的任务,且推理性能稳定。无论是需要创造性的内容生成,还是精确的语义分析,GPT-Omni 都能完成任务。

可定制性

针对特定的业务需求,GPT-Omni 支持模型微调,开发者可以根据自己的场景调整其行为,使其更贴近实际使用需求。

强大的集成能力

GPT-Omni 可轻松与现有系统集成,例如企业的客服系统、办公自动化平台或教育学习系统。

Mini-Omni2:轻量化的性能之选

在某些场景中,高性能模型可能并不是最优解,因为资源受限的设备或边缘计算场景更需要一款轻量、快速的模型。Mini-Omni2 就是为这些需求而生的产品:

轻量化设计

Mini-Omni2 在性能与资源消耗之间找到了平衡。其模型经过精简设计,可在资源受限的设备上运行,例如物联网设备、智能手机或嵌入式系统。

高效推理

虽然体积小巧,但 Mini-Omni2 的推理速度极快,在低功耗环境下依然能提供令人满意的响应时间。

灵活部署

Mini-Omni2 支持本地部署和边缘计算,与云端模型相比,它能够更好地满足数据隐私和实时性要求。

优化的任务能力

尽管 Mini-Omni2 的设计初衷是轻量化,但它仍保留了 NLP 的核心能力,例如意图识别、基础对话生成等任务,特别适合简单的对话机器人和自动化设备的应用。

应用场景

两款产品在实际应用中各有所长:

GPT-Omni

企业客服与知识库:处理复杂客户询问、生成智能响应。

内容生成:包括长篇文章、营销文案、社交媒体内容等。

教育领域:生成互动式课程材料,或为学生提供答疑服务。

Mini-Omni2

物联网设备:在智能家居中作为语音助手核心模块。

边缘计算场景:为工业自动化提供本地数据分析和指令生成支持。

轻量级应用:为小型企业开发简单的对话机器人或数据处理工具。

总结

GPT-Omni 和 Mini-Omni2 分别以“全能性”和“轻量性”定位,在不同的应用场景中提供优质解决方案。前者适合对功能和性能要求高的大型应用,后者则在资源受限的环境中表现卓越。

随着技术的不断进步和市场需求的演变,这两款产品都将在未来发挥更大的作用,为人工智能的普及和深化应用奠定坚实基础。

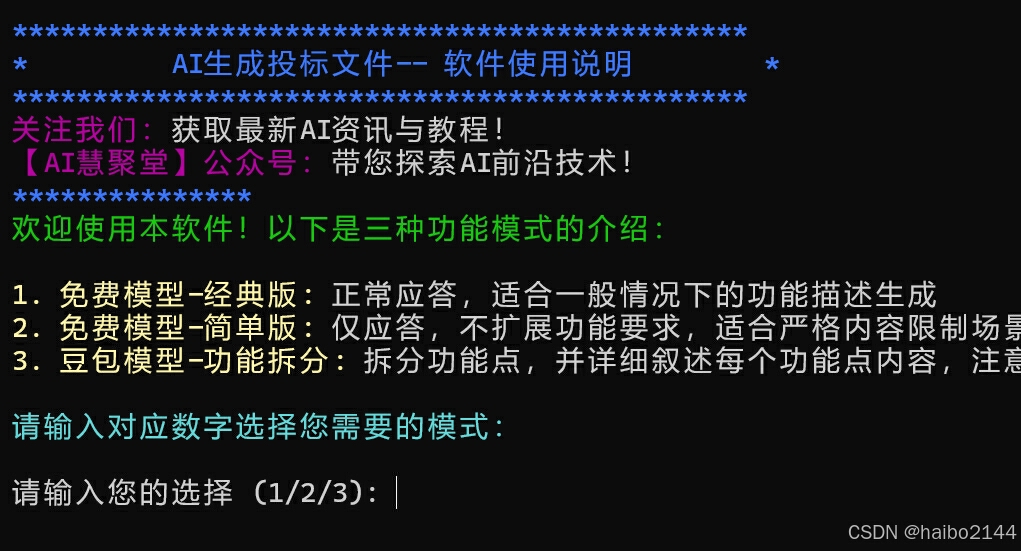

附一个AI编写标书工具