开发者朋友们大家好:

这里是 「RTE 开发者日报」 ,每天和大家一起看新闻、聊八卦。我们的社区编辑团队会整理分享 RTE(Real-Time Engagement) 领域内「有话题的新闻」、「有态度的观点」、「有意思的数据」、「有思考的文章」、「有看点的会议」,但内容仅代表编辑的个人观点,欢迎大家留言、跟帖、讨论。

本期编辑:@SSN,@鲍勃

01有话题的新闻

1、Suno 又整新活,发布了重磅功能「Covers」,一键翻唱任意歌曲

全球著名文生音乐模型 Suno 发布了重磅功能「Covers」,可以帮助用户一键翻唱任意风格的歌曲,可以是简单的录音或完整的歌曲。例如,上传一首流行歌曲《Original》,通过 Covers 就能识别歌曲里的乐谱、乐器、节奏以及旋律等,然后按照用户选择的新风格翻唱歌曲。

虽然整体节奏、旋律可能有一些变化,但会保留原歌曲的核心灵魂部分同时呈现出全新的风格。简单来说,就像让 ChatGPT 去模仿一个作者的特定写法、风格,来生成自己的内容。

除了上传音乐之外,还支持只用一小段声音样本就能完成声音识别完成音乐创作。也有网友通过 Covers,把自己的古典作品转换成了一首摇滚风格的曲目,整体效果非常惊艳。

目前,Suno 已经向所有的 Pro 和 Premier 订阅用户开放了 Covers 功能,但还处于早期测试阶段,也就是说该功能还会继续迭代完善。(@AIGC 开放社区)

2、StoryTribe :一个免费的在线故事板制作工具 无需绘画技能轻松制作故事板

故事板是一种视觉工具,用于通过一系列框架描绘故事或概念,类似于漫画。它最初用于电影行业,帮助有效规划和传达想法,通过简短描述关键时刻的动作或对话。

StoryTribe 是一个免费的在线故事板制作工具,专为专业人士设计,适用于视频制作人、营销人员、UX 设计师等。它帮助用户快速创建高质量的故事板,无需绘画技能。

StoryTribe 通过可自定义的元素和简单的绘图工具,帮助用户更轻松地创作故事板。它消除了复杂的提示编写过程,鼓励用户通过简单的绘画来表达创意。(@小互 AI)

3、阿里通义将发布 AI 视频生成大模型,支持文生视频、图生视频

消息称,阿里通义将在 2024 云栖大会(9 月 19 日至 9 月 21 日)期间发布视频生成大模型,目前通义 App 频道和通义万相 PC 端已上线「视频生成」入口,仅支持用户预约,但未开放使用。

页面内容显示,全新发布的视频生成大模型是由通义实验室自主研发,包含「文生视频」和「图生视频」两种创作模式。

据测试,预约成功后,阿里通义会在用户获得使用资格时进行通知,并赠送给用户 66 灵感值(有效期 30 天)。(@IT 之家)

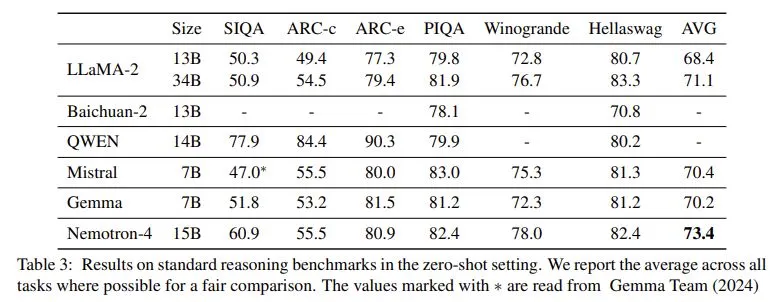

4、英伟达开源 Nemotron-Mini-4B-Instruct 小语言 AI 模型:专为角色扮演设计,9216 MLP、上下文长度 4096 词元

据报道称,英伟达开源了 Nemotron-Mini-4B-Instruct AI 模型,标志着该公司在 AI 领域创新又一新篇章。

Nemotron-Mini-4B-Instruct AI 模型专为角色扮演、检索增强生成(RAG)及函数调用等任务设计,是一个小语言模型(SLM),通过蒸馏(distilled)和优化更大的 Nemotron-4 15B 获得。

英伟达使用剪枝(pruning)、量化(quantization)和蒸馏(distillation)等先进 AI 技术,让该模型更小巧高效,尤其适用于设备端部署。这种缩小化并未影响模型在角色扮演和功能调用等特定场景下的性能,让其成为需要快速按需响应的应用的实用选择。

该模型在 Minitron-4B-Base 模型上微调,采用了 LLM 压缩技术,最显著的特点之一是其能够处理 4096 个上下文窗口词元(token),能够生成更长且更连贯的回复。

Nemotron-Mini-4B-Instruct 在角色扮演应用领域表现尤为突出,能够凭借其庞大的标记容量和优化的语言生成能力,嵌入到虚拟助手、视频游戏或任何其他需要 AI 生成关键响应的交互式环境中。

英伟达提供了特定的提示格式,以确保模型在这些场景中,尤其是在单轮或多轮对话中,输出最佳结果。该模型还针对函数调用进行了优化,在 AI 系统必须与 API 或其他自动化流程交互的环境中变得越来越重要。生成准确、功能性响应的能力使得该模型非常适合 RAG 场景,即模型需要创建文本并从知识库中检索和提供信息。(@IT 之家)

5、学者陶哲轩:o1 表现还不错,能当研究生用,但没有自己的思想

数学家、AI 学者陶哲轩近日在 Mastodon 平台上发文,表示自己已经提前试用了 OpenAI 新模型 o1 的更新版本,并发表了自己的体验和观点。

陶哲轩给新模型提出了一些具有挑战性的复杂分析问题,结果比 GPT4 要更好,能当研究生用,但仍然有点令人失望。陶哲轩认为,新模型可以以自己的方式得出良好的解决方案,但没有产生属于自己的关键概念思想,也犯了一些不小的错误。他形容自己使用 o1 的过程:「这种经历似乎与试图给一个平庸但并非完全不称职的研究生提供建议的经历差不多。」( @APPSO)

02有态度的观点

1、谢尔盖·布林:Google 不敢用 Transformer,作者剩一人了,现在我每天都在写代码

Google 创始人谢尔盖·布林在 All-In 峰会现场分享了他重返技术一线编写代码的原因,是因为 AI 领域的进展太过激动人心,作为计算机科学家,他不愿意错过这一波浪潮。

他认为 AI 技术将带来更广泛的变革,不仅限于搜索的延伸,还将影响编程和机器人学。相比于专精于某个领域的「专家模型」,布林更看好通用模型,Google 成功拿下 IMO 银牌模型,这源于 Google 在之前开始将形式证明模型中的某些知识和能力融合到通用语言模型之中的尝试。

布林指出 Google 在 AI 应用上存在一些「犹豫不决」的「保守」企业文化,这导致了风险规避和频繁裁员问题。布林表示,「虽然 AI 偶尔会犯大错,但更应及时发布。AI 不是那种你紧紧捂在怀里、隐藏起来、直到它变得完美无缺的技术。」他认为比 AI「犯蠢」更可怕的是,几年前的 Google 太胆小,不敢部署 Transformer,论文作者曾都离职了。

布林认为 AI 对人类有巨大价值,值得投入关注。他强调 AI 领域的竞争对发展有益,Google 会继续密切关注模型排行榜。(@APPSO)

写在最后:

我们欢迎更多的小伙伴参与「RTE 开发者日报」内容的共创,感兴趣的朋友请通过开发者社区或公众号留言联系,记得报暗号「共创」。

对于任何反馈(包括但不限于内容上、形式上)我们不胜感激、并有小惊喜回馈,例如你希望从日报中看到哪些内容;自己推荐的信源、项目、话题、活动等;或者列举几个你喜欢看、平时常看的内容渠道;内容排版或呈现形式上有哪些可以改进的地方等。

素材来源官方媒体/网络新闻

标签:视频,翻唱,Google,通义,AI,模型,Covers From: https://www.cnblogs.com/Agora/p/18418471