前言 本文没有动机在注意力机制内寻求创新。相反,它专注于在点云处理的背景下克服现有的准确性和效率之间的权衡,利用scale的力量。从3D大规模表示学习的最新进展中汲取灵感,我们认识到模型性能更多地受到规模的影响,而不是复杂设计的影响。因此,本文提出了Point TransformerV3(PTv3),它将简单性和效率置于某些机制的准确性之上,而这些机制在缩放后对整体性能来说是次要的。例如用以特定模式组织的点云的高效串行neighbor mapping来取代KNN的精确neighbor搜索。这一原理实现了显著的缩放,将感受野从16个点扩展到1024个点,同时保持高效(与前代PTv2相比,处理速度提高了3倍,存储效率提高了10倍)。PTv3在跨越室内和室外场景的20多项下游任务中取得了最先进的成果。PTv3通过多数据集联合训练进一步增强,将这些结果提升到更高的水平~

本文转载自3D视觉之心

仅用于学术分享,若侵权请联系删除

欢迎关注公众号CV技术指南,专注于计算机视觉的技术总结、最新技术跟踪、经典论文解读、CV招聘信息。

【CV技术指南】CV全栈指导班、基础入门班、论文指导班 全面上线!!

论文名称:Point Transformer V3: Simpler, Faster, Stronger

论文链接:https://arxiv.org/pdf/2312.10035.pdf

代码链接:https://github.com/Pointcept/PointTransformerV3

网络结构

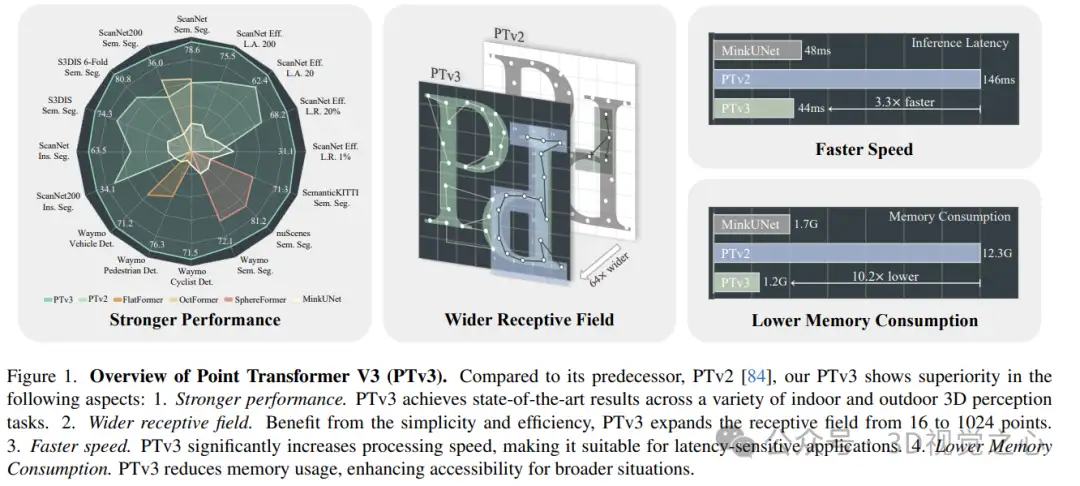

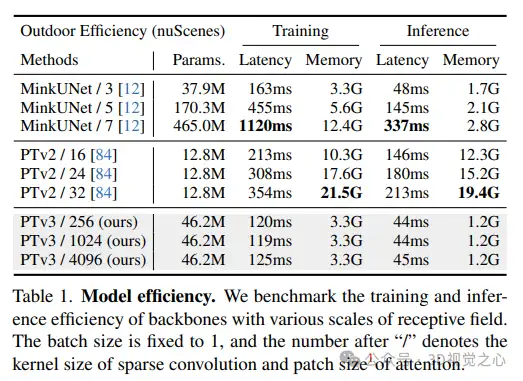

Point TransformerV3(PTv3)如下所示。与上一代PTv2相比,PTv3在以下方面显示出优势:1.更强的性能。PTv3在各种室内和室外3D感知任务中实现了最先进的结果。2.感受野较宽。得益于其简单高效,PTv3将感受野从16个点扩展到1024个点,速度更快。3. PTv3显著提高了处理速度,使其适用于对延迟敏感的应用程序。4.降低内存消耗,PTv3减少了内存使用,增强了更广泛情况下的可访问性。

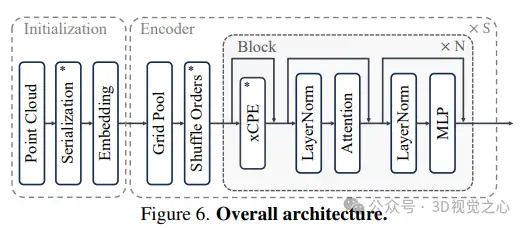

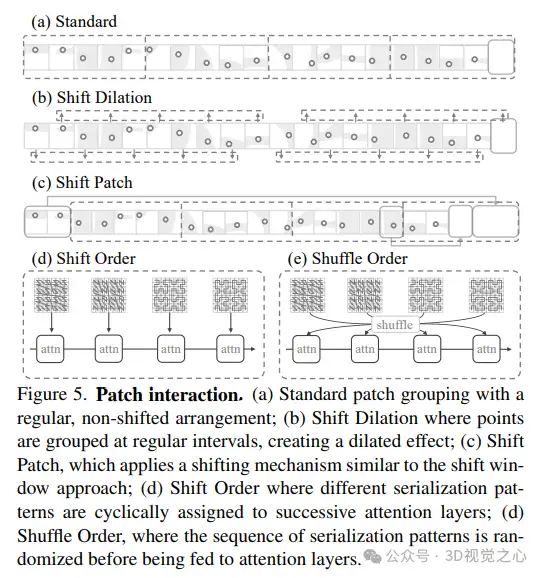

PTv3用一种为串行点云量身定制的精简方法取代了更复杂的注意力补丁交互机制,如移位窗口(阻碍注意力算子的融合)和邻域机制(导致高内存消耗)。PTv3消除了对相对位置编码的依赖,相对位置编码占前向时间的26%,有利于更简单的前置稀疏卷积层。

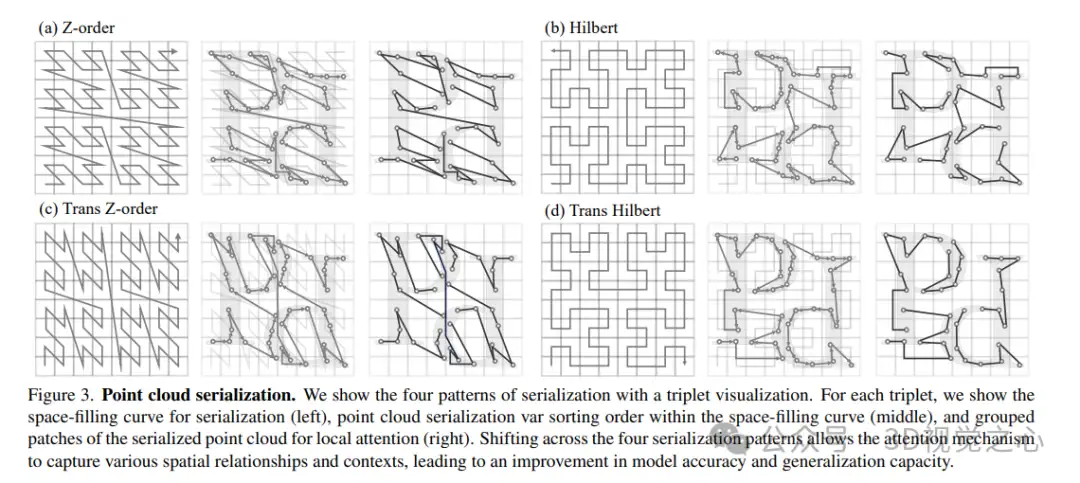

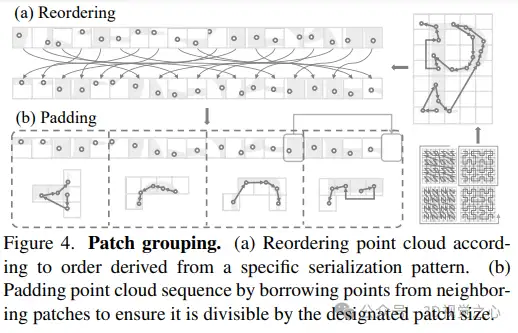

点云序列化:通过三元组可视化展示了序列化的四种模式。对于每个三元组,我们显示了用于序列化的空间填充曲线(左)、空间填充曲线内的点云序列化var排序顺序(中)以及用于局部关注的序列化点云的patch grouping(右)。通过在四种序列化模式之间转换,注意力机制可以捕捉各种空间关系和上下文,从而提高模型的准确性和泛化能力。

位置编码。为了处理海量数据,点云transformer通常采用局部注意力,这依赖于相对位置编码方法以获得最佳性能。然而,我们的观察结果表明,RPE的效率明显低下且复杂。作为一种更有效的替代方案,为点云transformer引入了条件位置编码(CPE),其中通过基于八叉树的深度卷积实现。我们认为这种替换是优雅的,因为RPE在点云变换器中的实现本质上可以被视为大核稀疏卷积的变体。即便如此,单个CPE也不足以达到峰值性能(当与RPE结合时,仍有可能额外提高0.5%)。因此,我们提出了一种增强的条件位置编码(xCPE),通过在注意力层之前直接准备具有跳过连接的稀疏卷积层来实现。实验结果表明,与标准CPE相比,xCPE完全释放了性能,延迟略微增加了几毫秒,性能增益证明了这种微小的权衡是合理的。

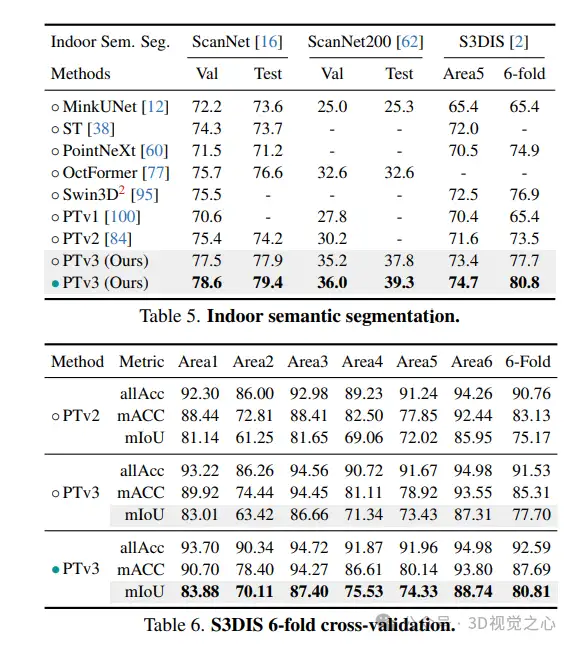

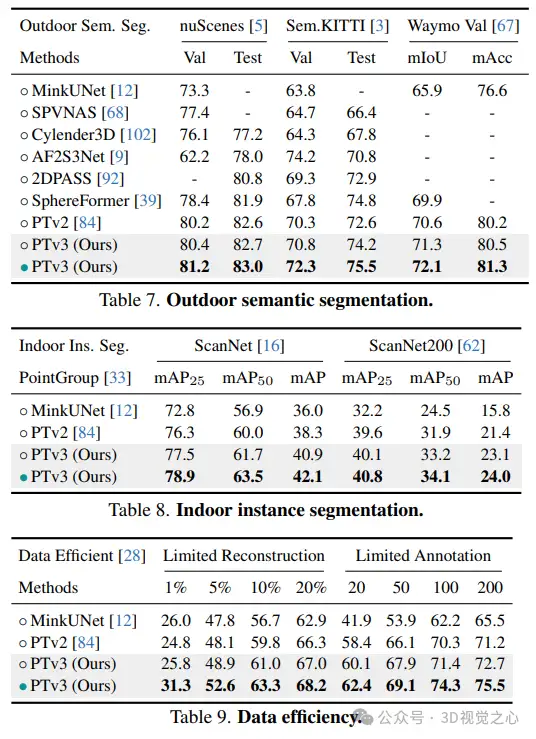

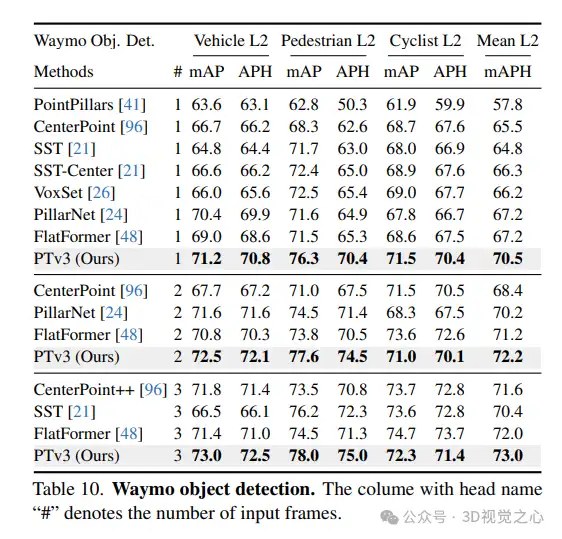

实验结果对比

效率对比:

性能对比:

欢迎关注公众号CV技术指南,专注于计算机视觉的技术总结、最新技术跟踪、经典论文解读、CV招聘信息。

【技术文档】《从零搭建pytorch模型教程》122页PDF下载

QQ交流群:470899183。群内有大佬负责解答大家的日常学习、科研、代码问题。

其它文章

LSKA注意力 | 重新思考和设计大卷积核注意力,性能优于ConvNeXt、SWin、RepLKNet以及VAN

CVPR 2023 | TinyMIM:微软亚洲研究院用知识蒸馏改进小型ViT

ICCV2023|涨点神器!目标检测蒸馏学习新方法,浙大、海康威视等提出

ICCV 2023 Oral | 突破性图像融合与分割研究:全时多模态基准与多交互特征学习

HDRUNet | 深圳先进院董超团队提出带降噪与反量化功能的单帧HDR重建算法

南科大提出ORCTrack | 解决DeepSORT等跟踪方法的遮挡问题,即插即用真的很香

1800亿参数,世界顶级开源大模型Falcon官宣!碾压LLaMA 2,性能直逼GPT-4

SAM-Med2D:打破自然图像与医学图像的领域鸿沟,医疗版 SAM 开源了!

GhostSR|针对图像超分的特征冗余,华为诺亚&北大联合提出GhostSR

Meta推出像素级动作追踪模型,简易版在线可玩 | GitHub 1.4K星

CSUNet | 完美缝合Transformer和CNN,性能达到UNet家族的巅峰!

AI最全资料汇总 | 基础入门、技术前沿、工业应用、部署框架、实战教程学习

标签:Transformer,Point,性能,注意力,V3,点云,PTv3,序列化,CV From: https://www.cnblogs.com/wxkang/p/18061251